Ya está aquí: la esperada nueva generación de tarjetas gráficas de NVIDIA, las GeForce RTX, ya han empezado a circular, y más vale tarde que nunca a continuación os vamos a mostrar de primera mano, en nuestro análisis, cómo es y qué rendimiento tiene la nueva NVIDIA GeForce RTX 2080 Founders Edition. La nueva GeForce RTX 2080 es la primera gráfica comercial de NVIDIA que se basa en la nueva arquitectura Turing, y a su vez cuenta con una nueva serie de tecnologías con las que el fabricante presume que han reinventado los gráficos para PC, como el ya famoso Ray Tracing.

Índice

- Introducción a la arquitectura Turing.

- La tecnología Deep Learning Super-Sampling (DLSS).

- La tecnología Ray Tracing en tiempo real.

- NVIDIA GeForce RTX 2080, descripción y características técnicas.

- ¿Qué son las gráficas Founders Edition?

- Overclock en las GeForce RTX.

- Embalaje y análisis externo.

- Análisis interno.

- Pruebas de rendimiento.

- Conclusión.

Introducción a la arquitectura Turing, diseñada para 4K a 60 FPS

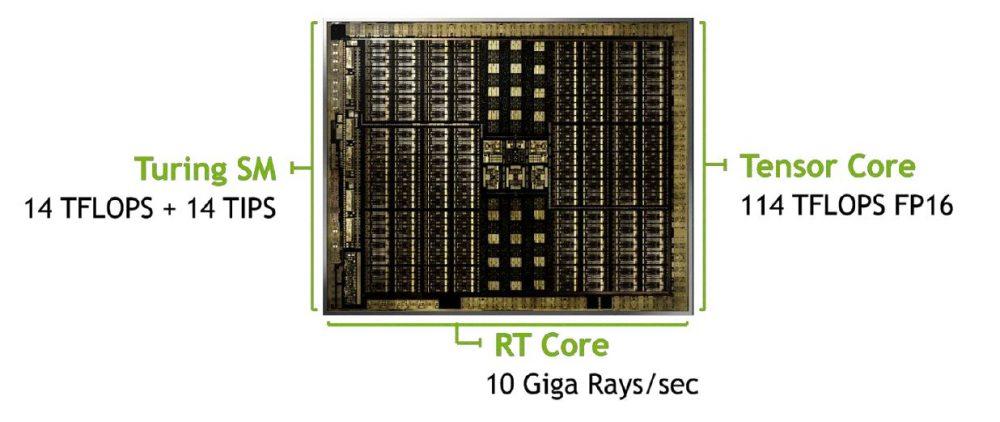

Turing es la primera arquitectura para GPU capaz de brindar a los videojuegos tanto Inteligencia Artificial (AI) como trazado de rayos en tiempo real (Ray Tracing). La arquitectura Turing incorpora en el SM (Streaming Multiprocessor) un nuevo componente llamado Tensor Core, un motor de IA de 114 TFLOPs que proporciona la potencia de la inteligencia artificial a los gráficos en tiempo real, así como el RT Core que añade aceleración de trazado de rayos a una tasa de 10 Giga Rays/s.

Dentro de la GPU TU102 de arquitectura Turing, que es el que utilizan las RTX 2080 Ti (las RTX 2080 utilizan el TU104, con 13.600 millones de transistores), encontramos 18.600 millones de transistores, lo que lo convierte en el segundo chip de GPU más grande del mundo, solo por detrás del GV100 que se utiliza en supercomputadoras.

En el título os decíamos que Turing es la primera arquitectura (según NVIDIA) diseñada específicamente para poder jugar a resolución 4K y 60 FPS, sin duda el sueño de todo gamer. Lo que es cierto es que la calidad y complejidad de los gráficos en los juegos es cada vez mayor, así como el hecho de que los gamers cada vez buscan experiencias más inmersivas, con mayores resoluciones, mayores tasas de refresco y por supuesto HDR. Sin embargo, la mayoría de juegos que cuentan con todo esto no se ejecutan a una tasa de frames por segundo decente a resolución 4K.

Turing, con sus 18.600 millones de transistores, es la primera GPU capaz de brindar el mejor gaming a resolución 4K y 60 FPS de manera sobrada en todos los juegos modernos (repetimos, que según NVIDIA, y para eso vamos a poner a prueba la gráfica en este análisis). El Turing Streaming Multiprocessor (SM) tiene una eficiencia 1.5 veces superior al de Pascal, la anterior arquitectura, y según la marca esto se traduce en dos factores:

- El SM Turing añade un nuevo camino de cálculos que permite a las operaciones de integrales y punto flotante ejecutarse al mismo tiempo.

- El camino de memoria del SM se ha rediseñado para contar con memoria compartida unificada, caché de texturas y caché de la propia carga de memoria en una sola unidad, lo que se traduce en literalmente el doble de ancho de banda y el doble de capacidad cuando hablamos de caché L1. Es un nuevo escalón que han introducido y que han llamado caché 0.

Por último, a destacar que Turing es la primera arquitectura que cuenta con memoria gráfica de nueva generación: GDDR6 a 14 Gb/s.

La tecnología Deep Learning Super-Sampling (DLSS)

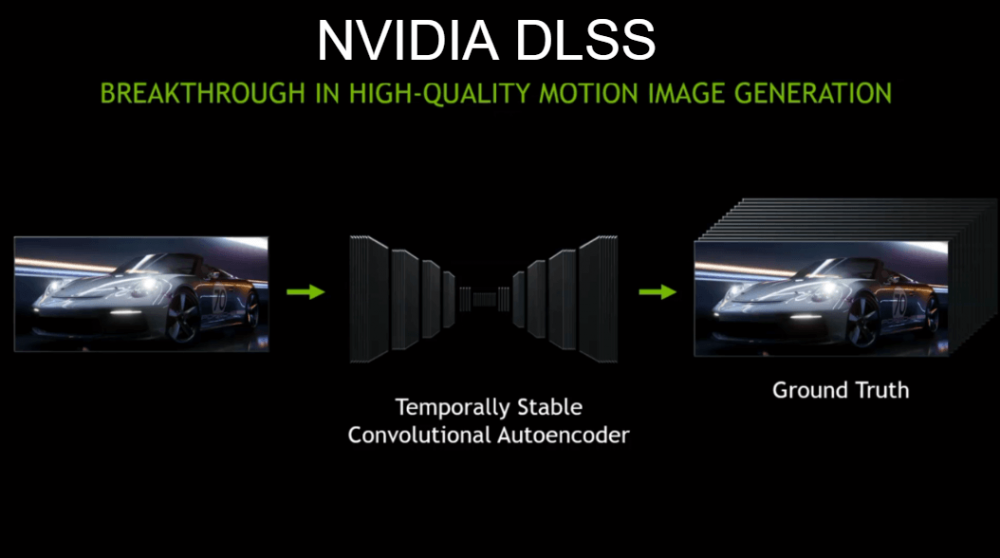

Antes os comentamos que las nuevas GPUs Turing incorporan un nuevo elemento llamado Tensor Cores, con una capacidad de cómputo de 114 TFLOPs. Éstos se utilizan para mejorar el rendimiento mediante una característica denominada Deep Learning Super Sampling (DLSS), que hace uso de una red neural para extraer características multidimensionales de la escena renderizada y, de manera autónoma, es capaz de combinar los detalles de múltiples frames para construir una imagen final de alta calidad.

Esto se traduce en que las GPUs Turing son capaces de utilizar la mitad de samples para renderizar la misma imagen, gracias a que parte de ella la hace la IA automáticamente. El resultado es que se renderiza exactamente lo mismo (que en la mayoría de juegos hace uso de TAA para esto) pero con un mejor rendimiento, más rápido y consumiendo menos recursos ya que parte del trabajo lo hace ya la IA. Además, según NVIDIA DLSS es muy sencillo de integrar, y ya anunciaron 25 juegos compatibles con ésta tecnología.

Ray Tracing en tiempo real, el Santo Grial en los gráficos

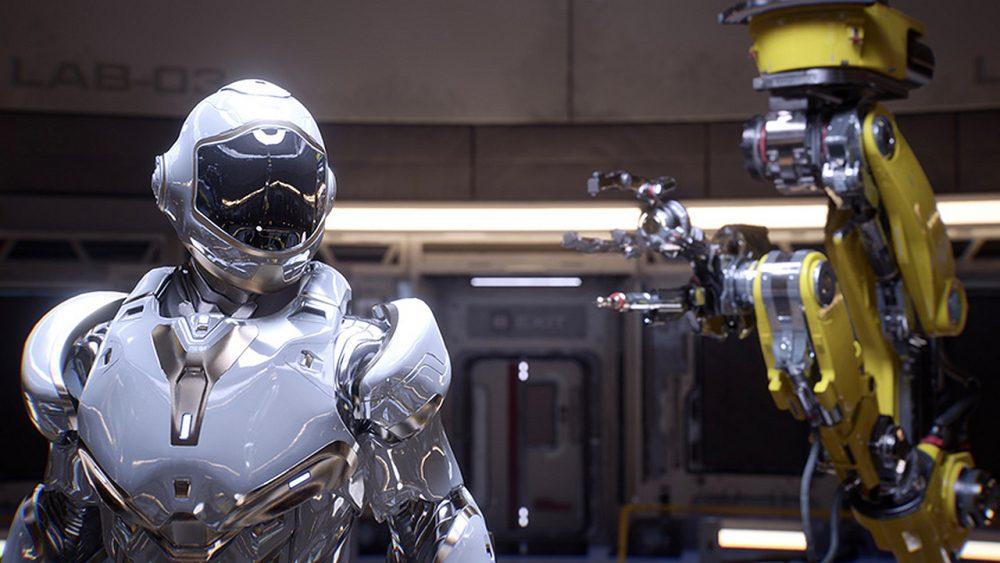

El trazado de rayos en tiempo real (Ray Tracing) se considera el Santo Grial en la industria de los gráficos. Es una tecnología de renderizado de cómputo intensivo que simula de manera realista la iluminación de las escenas y sus objetos. Ray Tracing no es nuevo en sí mismo, pues lleva años siendo utilizada en la industria del cine, diseño y arquitectura pero, y esto sí es la novedad, no con renderizado en tiempo real.

Implementar Ray Tracing a tiempo real en las nuevas GPUs de NVIDIA ha requerido más de 10 años de desarrollo y colaboración entre los ingenieros de NVIDIA de I+D, los de diseño de hardware, y los de diseño de software. Ray Tracing es posible ahora, en tiempo real e implementado en los juegos modernos, gracias a la invención de los RT Cores combinados con el software NVIDIA RTX.

Os recomendamos la lectura del siguiente artículo sobre el Ray Tracing que publicamos hace poco en la web:

NVIDIA GeForce RTX 2080, descripción y características técnicas

La GeForce RTX 2080 que analizamos en el día de hoy está basada en el chip Turing TU104, que contiene 13.600 millones de transistores en su interior, convirtiéndose en una GPU mucho más compleja que la anterior tope de gama de la marca, la TITAN XP. La GeForce RTX 2080 está diseñada para gamers que buscan jugar a resolución 4K en máxima calidad de detalles, y según el fabricante esta tarjeta gráfica es capaz de proporcionar una experiencia gaming a resolución 4K, 60 FPS e incluso con HDR sin complicaciones.

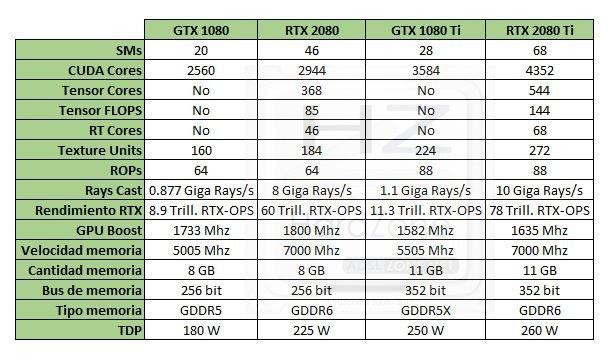

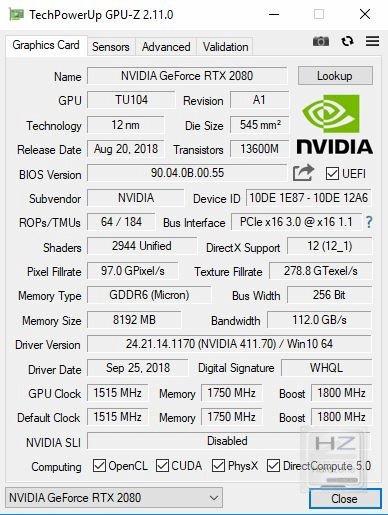

Esta gráfica cuenta con 2944 CUDA Cores, 46 RT Cores y 368 Tensor Cores, con una velocidad base de funcionamiento de 1710 Mhz. Como la RTX 2080 Ti, la Founders Edition se ofrece con 90 Mhz de Overclock de fábrica, por lo que estamos ante una gráfica que ya de serie funciona a 1800 Mhz. Por otro lado, la GPU incorpora 64 ROPs con una tasa de relleno de píxeles de 109.4 Gigapíxels/s, y 184 unidades de textura que generan una tasa de relleno de texturas de hasta 314.6 Gigatextels/s.

En cuanto a la memoria, la RTX 2080 incorpora ocho controladores de 32 bits (256 bits en total) que manejan un total de 8 GB de memoria GDDR6 con una velocidad de 14 Gbps, lo que proporciona un ancho de banda de memoria de hasta 448 GB/s.

En la siguiente tabla, podemos ver comparadas las características técnicas de esta GeForce RTX 2080 en comparación con su homónima de generación anterior, la GTX 1080, así como con su hermana mayor, la RTX 2080 Ti que también analizaremos en breve, y la GTX 1080 Ti de arquitectura Pascal (Nota: todos los modelos de la tabla son los Founders Edition).

¿Qué son las tarjetas gráficas la Founders Edition?

¿Qué son las tarjetas gráficas la Founders Edition?

Ya desde la pasada generación de gráficas, NVIDIA lanzó lo que denominaron “Founders Edition”, unas gráficas vendidas directamente por la marca con disipador de cámara de vapor. No obstante, para estas GeForce RTX, NVIDIA mantiene la Founders Edition pero ha cambiado notablemente el disipador, que pasa de ser de tipo blower con cámara de vapor a un diseño más convencional de doble ventilador.

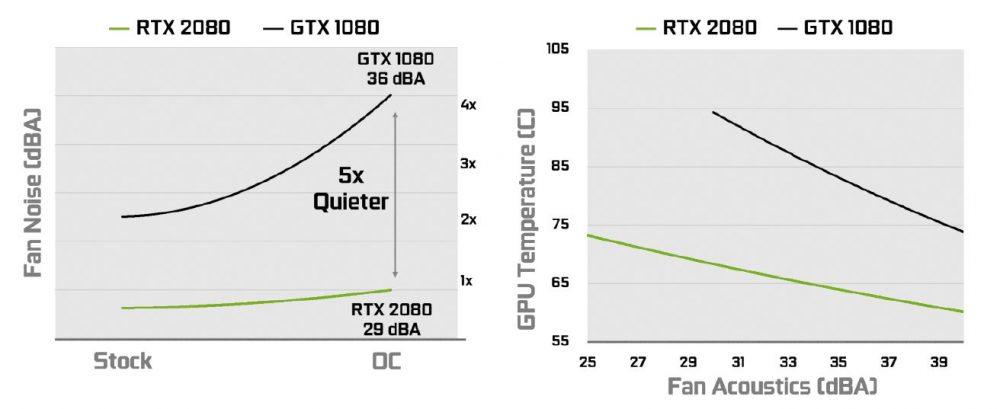

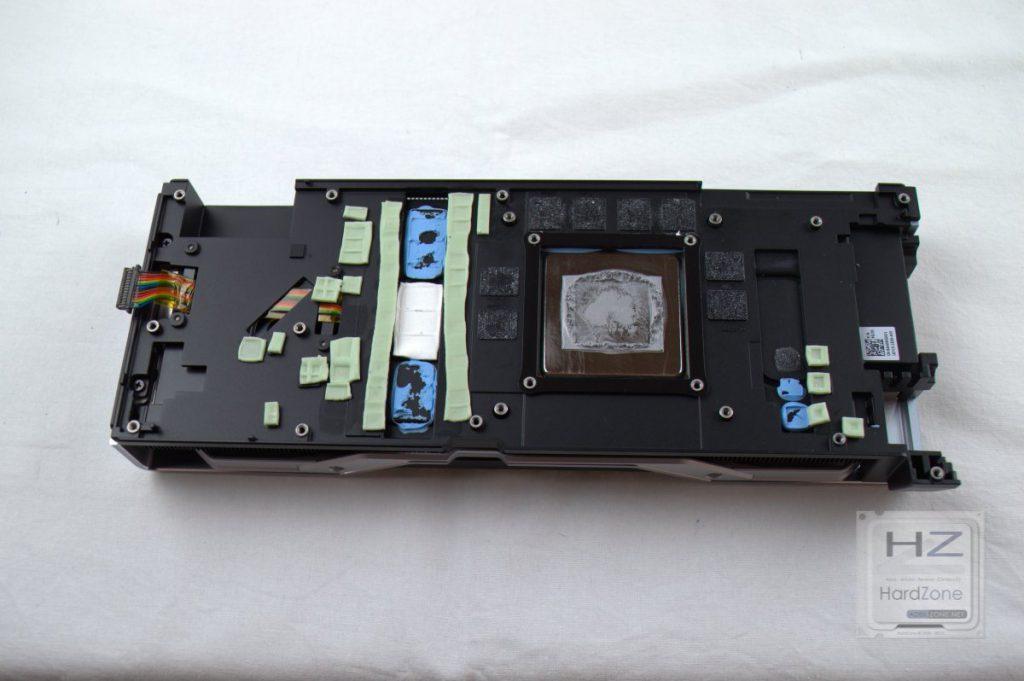

La gran novedad del disipador es la inclusión de estos dos ventiladores, ambos con 13 aspas que refrigeran todo el entramado de láminas de aluminio de manera efectiva sin necesidad de girar demasiado rápido (y por lo tanto emitiendo mucho ruido). NVIDIA mantiene, no obstante, el sistema de refrigeración por cámara de vapor pero ahora ésta cubre todo el PCB, proporcionando así un mayor área de disipación de calor. Finalmente, el sistema de ventiladores empuja el aire caliente fuera por los laterales y la parte trasera, refrigerando incluso los chips de memoria GDDR6.

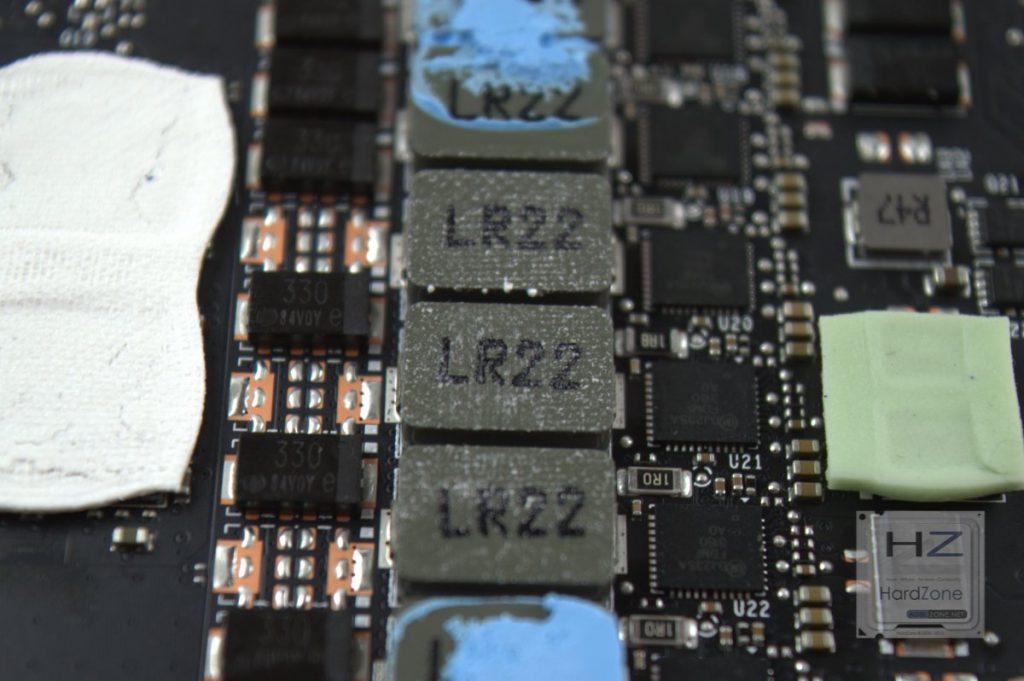

Hay que destacar también el hecho de que NVIDIA ha mejorado el sistema de fases VRM en estas Founders Edition, en comparación con las versiones de generación anterior. Por ejemplo, antes la GTX 1080 Ti tenía un sistema dual-FET de 7 fases, mientras que la RTX 2080 Ti tiene un sistema de 13 fases llamado iMON DrMOS (la RTX 2080 que analizamos hoy tiene este mismo sistema pero de 8 fases), un sistema de alimentación que introduce un control más estricto de la energía, por lo que se desaprovecha menos y, con ello, se genera menos calor. La RTX 2080 Ti tiene un sistema adicional de 3 fases para la memoria.

Según el fabricante, las Founders Edition son gráficas para los usuarios más exigentes en cuanto a calidad y durabilidad, y por ello cuentan con un acabado en aluminio con proceso CNC que les da un acabado premium. Por otro lado, en lugar de hacer uso de un backplate convencional, NVIDIA ha “envuelto” completamente la gráfica con aluminio, dándole un aspecto de cohesión y solidez más grande, donde incluso el conector NVLink está protegido por una cubierta de quita y pon.

Por otro lado, las gráficas Founders Edition cuentan con cierto nivel de Overclock de fábrica para ofrecer un mayor rendimiento que las versiones básicas, y según NVIDIA todas y cada una de las gráficas de esta familia son probadas de manera individual para asegurarse de su estabilidad y buen funcionamiento general; no en vano, tienen 3 años de garantía directamente con NVIDIA.

Finalmente, cabe destacar que tanto la RTX 2080 Ti como la RTX 2080 Founders Edition cuentan con tres salidas DisplayPort 1.4ª que son capaces de manejar pantallas de resolución 8K a 60 Hz con un solo cable. También hay un conector HDMI 2.0b con soporte para HDCP 2.2 y un conector VirtualLink (USB Type-C reversible), preparado para los sistemas de realidad virtual de próxima generación.

El Overclock en las GeForce RTX

Con todo lo que os hemos explicado hace un momento, ya supondréis que las GeForce RTX son unas gráficas que cuentan con un gran margen de temperatura y de energía para poder elevar su frecuencia de funcionamiento, y es que ya NVIDIA dijo que estas gráficas están diseñadas para el Overclock.

Y no nos referimos únicamente al Overclock convencional que realizamos “a mano” los usuarios en la GPU, sino al Overclock dinámico que se controla mediante la tecnología GPU Boost, que monitoriza los parámetros de la gráfica y eleva o disminuye la velocidad de funcionamiento dependiendo de las condiciones y límites establecidos.

GPU Boost 3.0

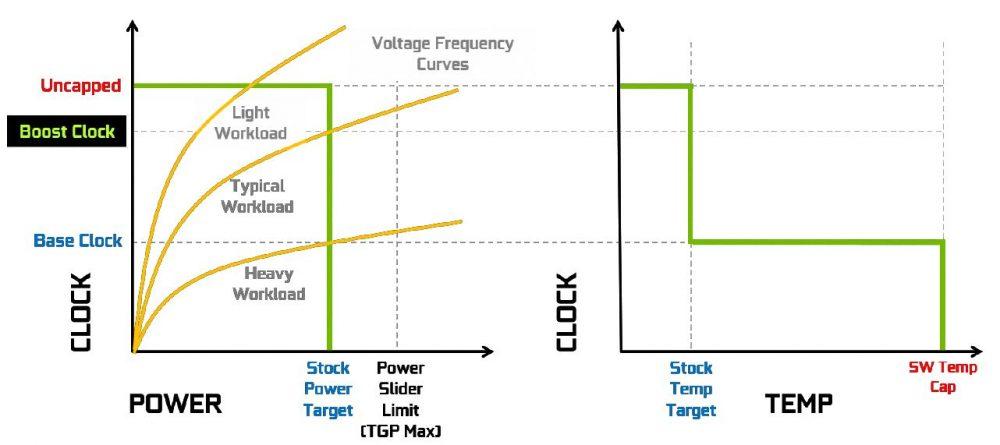

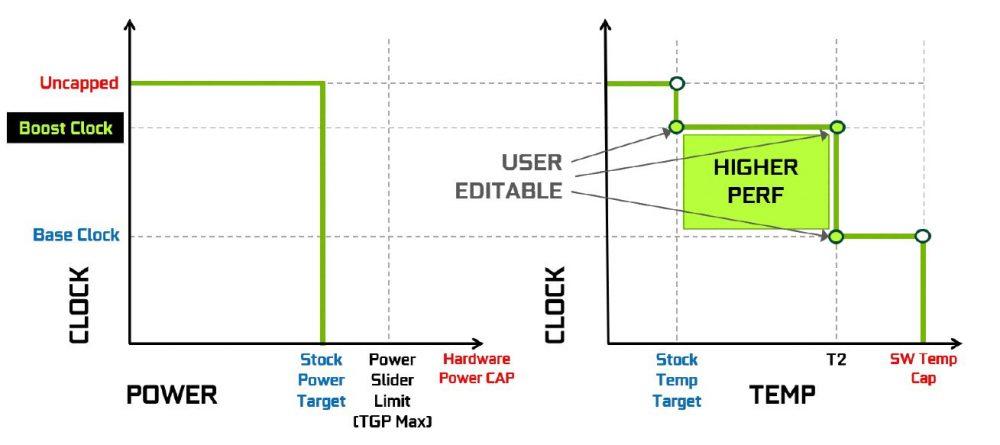

Una manera de pensar sobre el algoritmo que utiliza GPU Boost es pensar sobre las restricciones impuestas de fábrica, o en otras palabras, los límites que NVIDIA impone para asegurarse de que la temperatura y los voltajes están en valores seguros que no van a dañar la tarjeta gráfica. Esto se puede ver de manera visual en el siguiente gráfico.

Con GPU Boost 3.0, el límite de energía de la GPU se establece mediante el parámetro Power Target, y como se puede ver en el gráfico de la izquierda (Stock power target) los usuarios pueden manipularlo dentro de unos límites. Con la temperatura es similar, pues se permite que el usuario eleve el máximo de temperatura hasta cierto límite para permitir mayores velocidades de funcionamiento. Estos dos valores son los que modifican el algoritmo de GPU Boost para que proporcione la máxima velocidad de funcionamiento posible.

El gráfico ilustra, así mismo, las características clave de GPU Boost 3.0. Primero, la velocidad de reloj se establece sin límite mientras que la potencia esté por debajo del valor de Power Target, y mientras que la temperatura esté por debajo del Temp Target, es decir, por debajo de los límites establecidos. Segundo, cuando llega una carga de trabajo se aplica una velocidad de reloj adecuada según estos parámetros. Finalmente, cuando la temperatura o la potencia se eleva y llega al límite establecido, la velocidad de reloj volverá a su valor base para preservar la integridad del sistema.

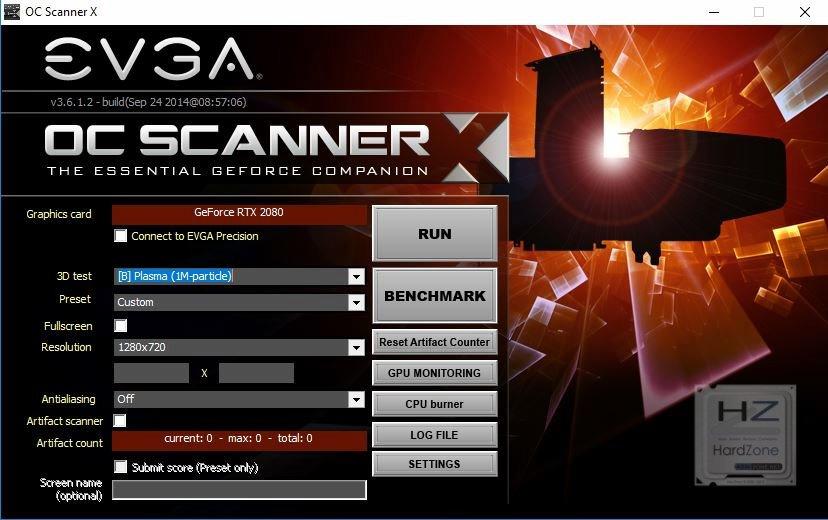

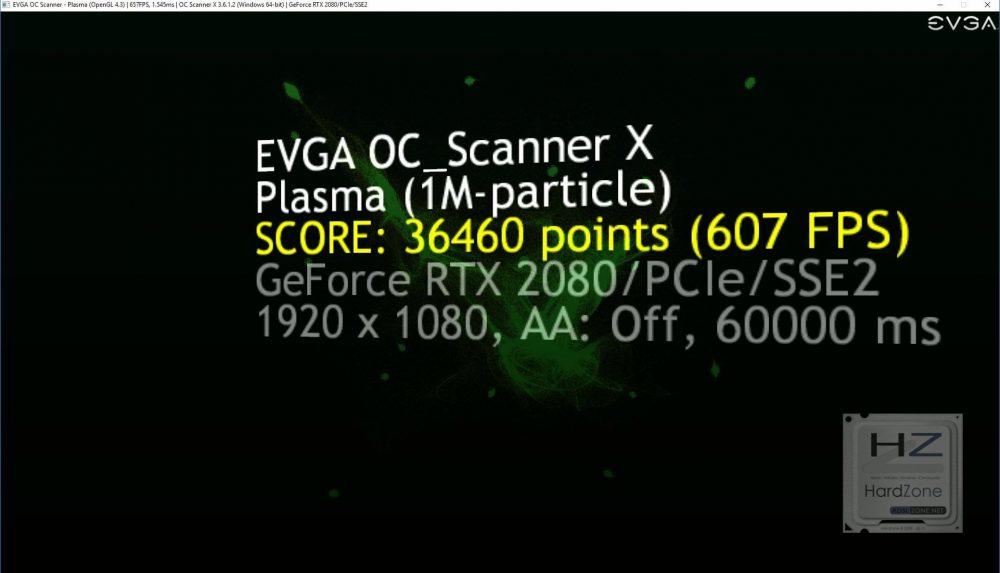

Las dos siguientes capturas son las que hemos obtenido con OC Scanner de EVGA. Si bien es la primera vez que utilizamos esta herramienta y, por lo tanto, no podemos compararlo con ninguna tarjeta gráfica hasta el momento, nos servirá como punto de partida y referencia para futuras comparativas que realicemos.

GPU Boost 4.0

Como sucede cada vez que NVIDIA lanza una nueva generación de tarjetas gráficas -o más bien nueva arquitectura-, el fabricante proporciona nuevas herramientas para que los usuarios puedan modificar los parámetros de Overclock. GPU Boost 4.0 es la cuarta iteración, y añade la posibilidad de ajustar manualmente los algoritmos que utiliza GPU Boost y que hemos explicado hace un momento.

La diferencia radica en que los algoritmos utilizados por GPU Boost 3 estaban íntegramente dentro del driver, y no estaban expuestos a los usuarios. Esto cambia en GPU Boost 4, que ahora muestra los algoritmos a los usuarios y permite su ajuste manual mediante la modificación de las curvas que vemos en los gráficos. Donde antes encontrábamos una línea recta, ahora podemos crear una curva (en el sentido de que tenemos un control muchísimo mayor) que permitirá que la velocidad de funcionamiento de la gráfica esté siempre al máximo posible que permitan tanto la temperatura como el consumo energético. Y, lo que es más importante, al llegar al límite no bajará a la velocidad base sino que se mantendrá a la máxima posible.

En la captura de pantalla de EVGA PrecissionX1 que se puede ver arriba, se ve de manera más clara. Aquí, se han configurado todos los puntos de velocidad de reloj en función de la temperatura, colocándose casi a 2000 Mhz en el mejor escenario. De esta manera, los usuarios tendremos una mejor precisión y podremos asegurarnos de que el rendimiento siempre será máximo, y mejor todavía cuanto mejor sea la temperatura de funcionamiento (es decir, que beneficia en gran medida a los disipadores de buena calidad, refrigeraciones líquidas y cajas bien ventiladas).

NVIDIA Scanner

Los entusiastas adoran, por regla general, hacer overclock a sus equipos, pero no todo el mundo tiene el tiempo ni los conocimientos técnicos necesarios para poder aprovechar al máximo las capacidades de overclock de su hardware. Por ello, NVIDIA ha estado trabajando en una nueva serie de APIs que permitirán que cualquiera realice Overclock a la tarjeta gráfica con solo apretar un botón.

Es ahí donde entra NVIDIA Scanner, un nuevo sistema que lanza un hilo de proceso para poner a prueba la GPU. Este hilo de proceso ejecuta un algoritmo matemático que determina la estabilidad, haciendo pruebas con diferentes valores de velocidad de funcionamiento. Además, podremos arrancarlo y pausarlo sin problemas, que no perderemos los datos que haya ido recopilando (si bien según NVIDIA no tarda más que 20 minutos en hacer una prueba completa).

Ya antes os comentamos que el usuario puede modificar los parámetros de Power y Temperature Target, y estos lógicamente tienen un impacto en cómo opera NVIDIA Scanner dependiendo de los puntos en los que los hayamos establecido. En cualquier caso, NVIDIA Scanner irá haciendo pruebas a diferentes velocidades y establecerá los máximos posibles según nuestro hardware y temperatura.

Embalaje y análisis externo

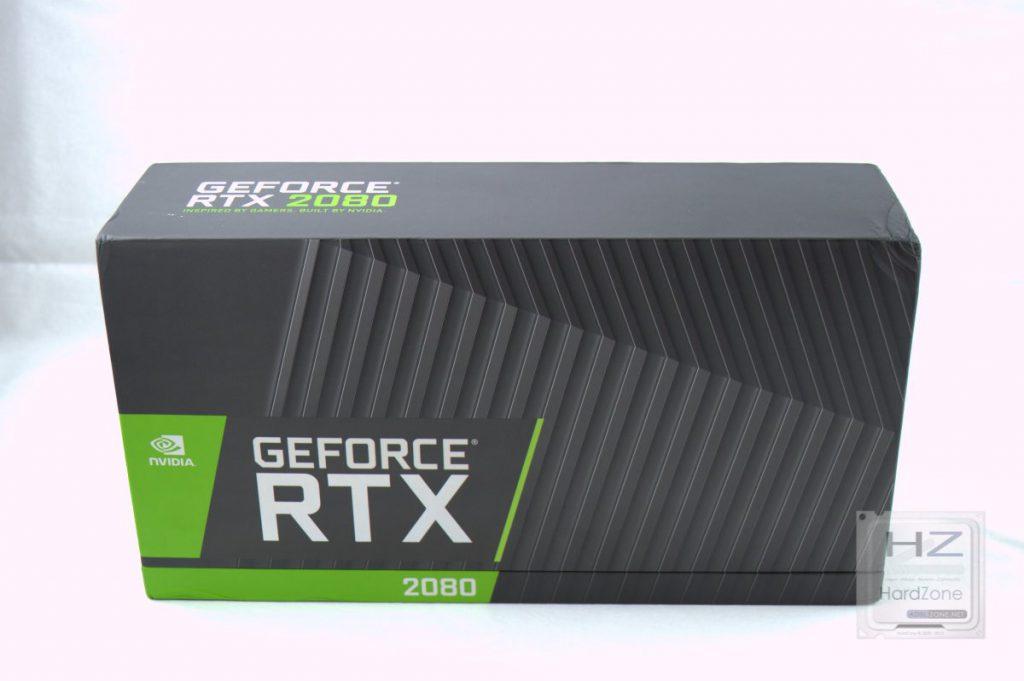

Como todas las ediciones Founder Edition, esta GeForce RTX 2080 viene embalada en una caja de cartón duro que se abre hacia arriba, decorada con los motivos habituales de la marca pero que, en esta ocasión, destaca el anagrama RTX en la parte frontal y laterales.

Al retirar la cubierta superior, encontramos la tarjeta gráfica a modo de exposición, pero encajada perfectamente para que no se mueva durante el transporte de la caja y así evitar que se dañe.

Junto con la gráfica, NVIDIA incluye una pequeña caja de cartón blando y color negro en cuyo interior encontraremos la guía de uso rápido y un adaptador de DisplayPort a DVI.

Tal y como os contamos antes, en la descripción de esta Founders Edition, la gráfica cuenta ahora con dos ventiladores y cámara de vapor sobre dimensionada, todo adornado con un backplate de aluminio plateado que cubre toda la gráfica. En la siguiente galería podréis apreciar los detalles de la parte delantera.

Vamos a los laterales, donde encontramos el logo de GeForce RTX en el lado visible que se iluminará en color verde cuando tengamos la gráfica funcionando, y en este mismo lateral encontramos los dos conectores PCI-Express, en este caso uno de 8 y otro de 6 pines.

También aquí está el conector NVLink, protegido por un plástico para preservar su integridad cuando no lo estemos utilizando.

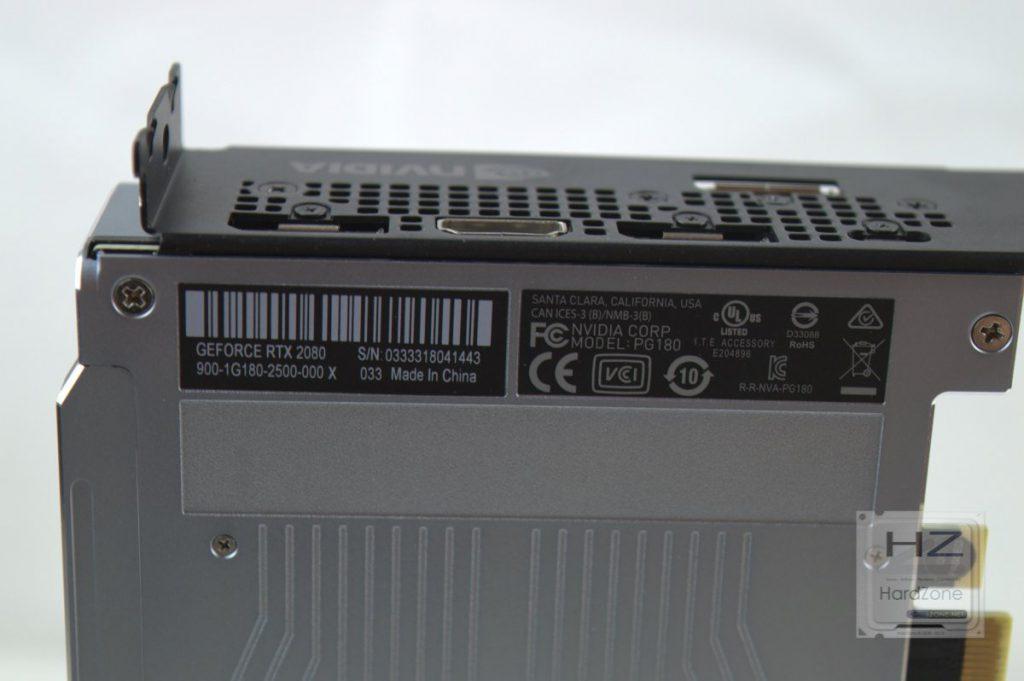

La parte trasera y el backplate están desprovistos de nada relevante salvo logos de la marca y la etiqueta identificativa de rigor.

Finalmente, tenemos la zona de conexiones, en este caso de color negro (novedad muy acertada, por cierto, pues generalmente siempre es de color plateado y desentona con la estética habitual de las cajas de PC) en la que además de una rejilla de salida de aire encontramos tres conectores DisplayPort, un HDMI y un USB Type-C, tal y como explicamos en las características de la gráfica.

Análisis interno

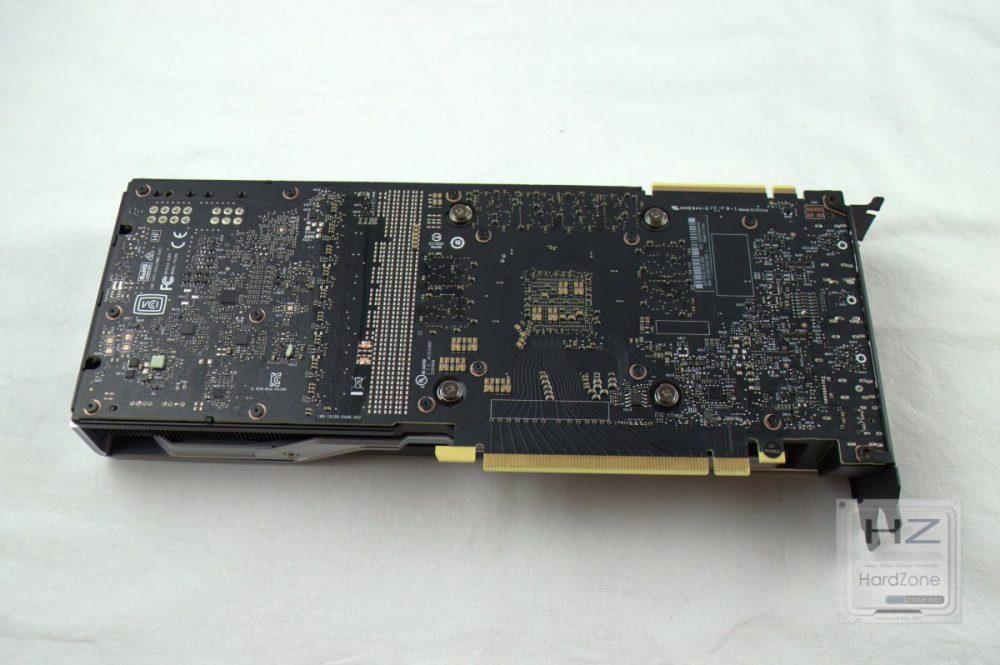

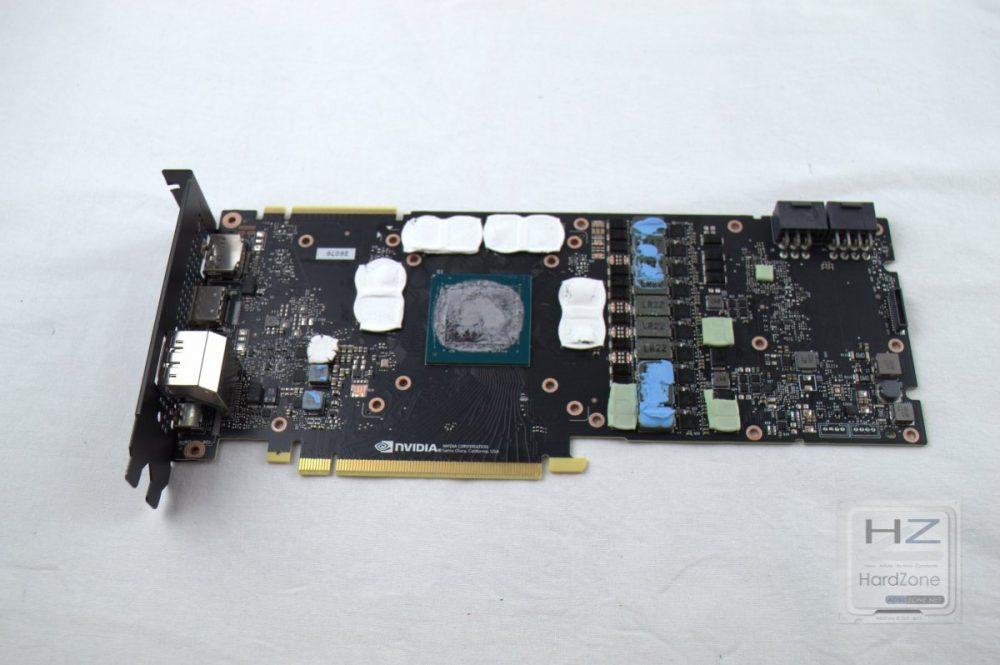

Vamos ahora a ver el interior de la gráfica, y hay que decir que si bien el disipador es bastante estético y queda bien, para acceder al interior de la gráfica tendremos que dedicar bastante tiempo y paciencia puesto que hay una infinidad de tornillos que tendremos que retirar. Para empezar, el backplate trasero lo podemos quitar retirando nada menos que 16 tornillos (no es difícil para nada, pero sí laborioso), dejándonos ver toda la parte trasera del PCB de la gráfica.

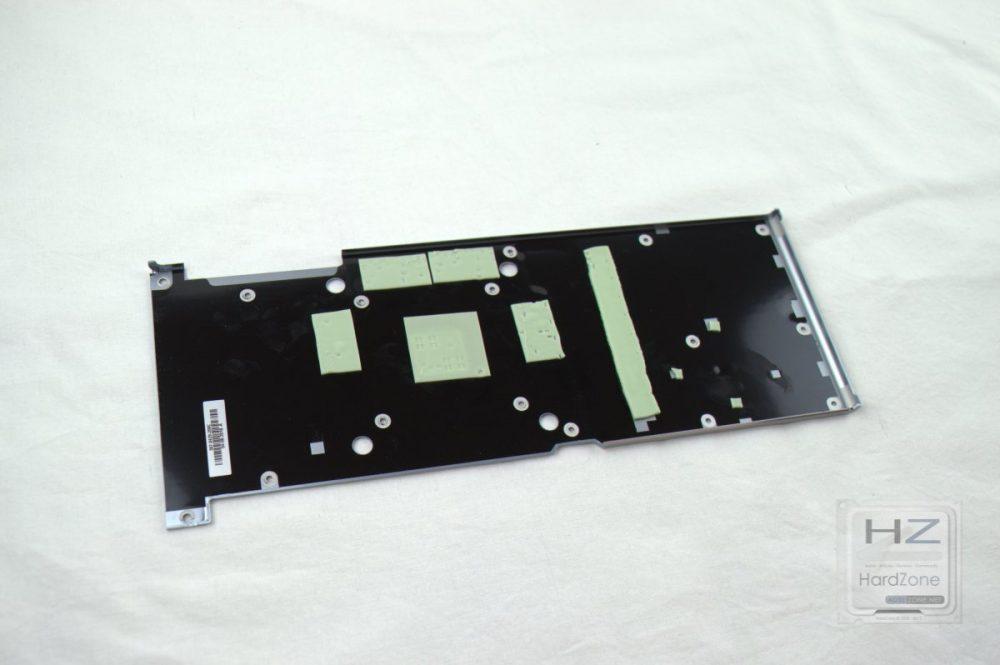

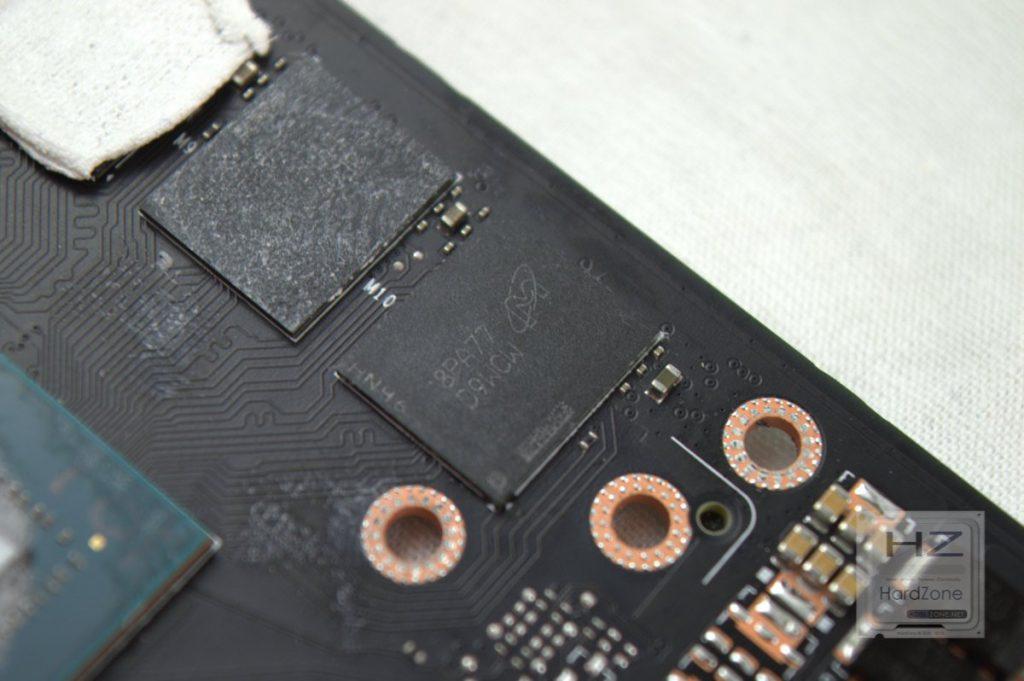

La parte interior del backplate trasero cuenta con algunos pad térmicos para colaborar con la disipación de calor, algo que está muy bien teniendo en cuenta el calor que generan los componentes modernos, si bien es cierto que en esta ocasión los chips de memoria GDDR6 solo están en la cara interior del PCB y no en la trasera, como sucedía con generaciones pasadas.

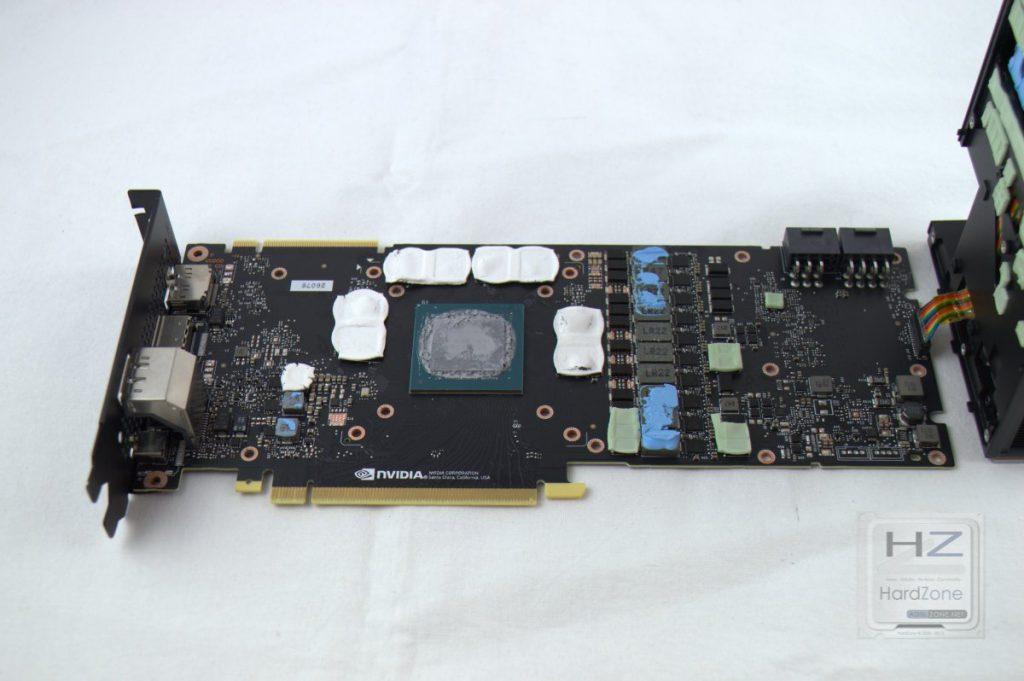

Acceder al interior es todavía más complicado, puesto que tendremos que retirar cuatro tornillos Phillips (los de la propia GPU) y otros 14 más con forma de tuerca (que son la base en la que se atornilla el backplate), además de tres tornillos Phillips más ubicados en la zona de conectores trasera. En total tendremos que retirar 37 tornillos (por eso decíamos que es laborioso).

Esto ya nos da acceso a ver el interior del PCB, con la GPU TU-104 en el centro rodeada de los chips de memoria GDDR6 y demás componentes que en seguida os enseñamos. Pero cuidado, porque el disipador, de una sola pieza, está todavía unido al PCB y tendremos que desconectar el conector para poder retirarlo.

Aquí tenéis finalmente la cara interior del PCB de la GeForce RTX 2080 Founders Edition de NVIDIA, con la GPU TU-104-400A-A1 ubicada en pleno centro y rodeada -salvo por debajo- por los chips de memoria GDDR6 fabricados por Micron. En la zona derecha tenemos los VRM de alimentación, mostrando una disposición exactamente igual que en el resto de tarjetas gráficas de la marca.

Pruebas de rendimiento

Hora de conectar la gráfica a nuestro banco de pruebas y ver qué tal se comporta a la hora de la verdad.

El banco de pruebas es el habitual, consistente en el siguiente hardware:

- Intel Core i7-8700K.

- Be Quiet! Dark Rock Pro 4.

- MSI Z370 Gaming M5.

- 2x8GB G.Skill SniperX DDR4 3600 Mhz.

- Corsair RM1000i.

- Corsair MP500 480GB.

- Corsair Neutron XTi 480GB.

- Corsair Obsidian 750D Airflow.

Para las pruebas hemos utilizado Windows 10 Pro de 64 bits con todas las actualizaciones instaladas (obligatorias por otra parte porque si no, ni siquiera podemos instalar los últimos drivers de NVIDIA), y los controladores gráficos GeForce 411.70 WHQL.

Comenzamos como siempre con la captura de rigor de GPU-Z.

Consumo y temperatura

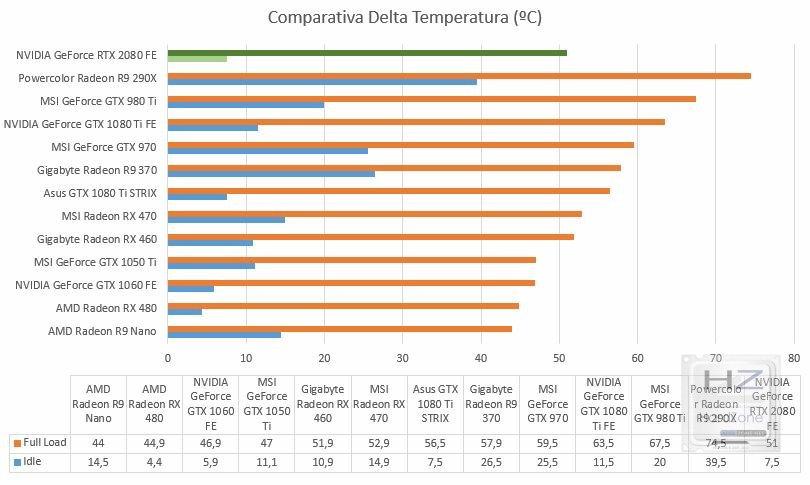

Vamos a empezar a hablar de la temperatura. La gráfica que podéis ver a continuación es el Delta de temperatura, es decir, la temperatura medida menos la temperatura ambiente, de manera que si ésta última varía durante las pruebas no afecte a la comparativa con otras gráficas.

Queda bastante claro no solo que la RTX 2080 se mantiene a buena temperatura de funcionamiento incluso a máxima carga, sino que NVIDIA ha acertado de pleno con el nuevo diseño del disipador de sus tarjetas gráficas Founders Edition.

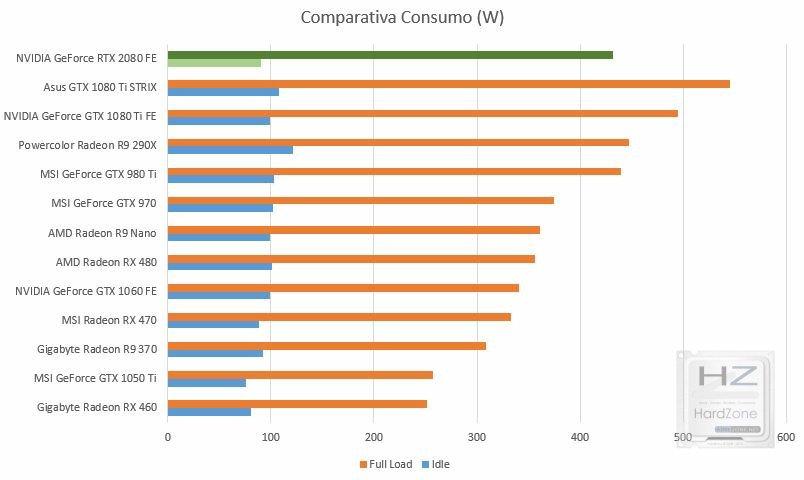

En cuanto al consumo, como siempre, hemos utilizado un medidor de enchufe Efergy eSocket para medir el consumo global del equipo. Solo hemos medido el consumo del sistema completo, sin monitor, y éste ha sido el resultado tanto en reposo (idle) como en Full Load (Prime95 + Furmark + HD Tune).

Con un consumo máximo por debajo de los 450 vatios en un equipo de alta gama como es el caso, podemos decir que NVIDIA ha vuelto a hacer un buen trabajo en cuanto a la eficiencia, reduciendo incluso el consumo que teníamos en este equipo con una GeForce GTX 1080 Ti.

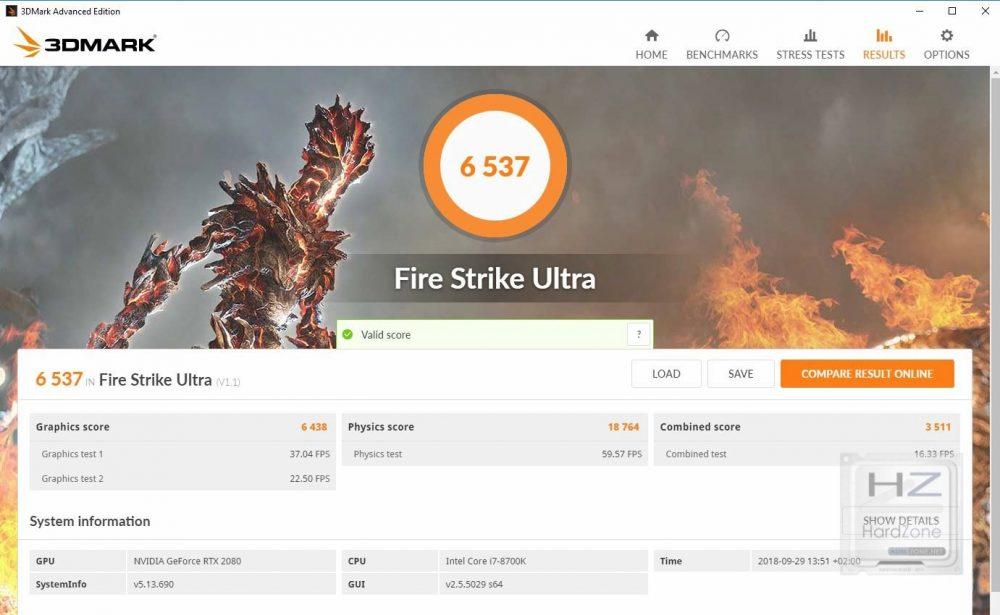

3DMark

Nada mejor que 3DMark para ver el rendimiento en benchmarks sintéticos de ésta tarjeta gráfica, aunque en éste caso solo hemos usado el más exigente de los Fire Strike dado que con gráficas de éste calibre ya no tiene sentido usar benchmarks más “flojos”. Éste ha sido el resultado.

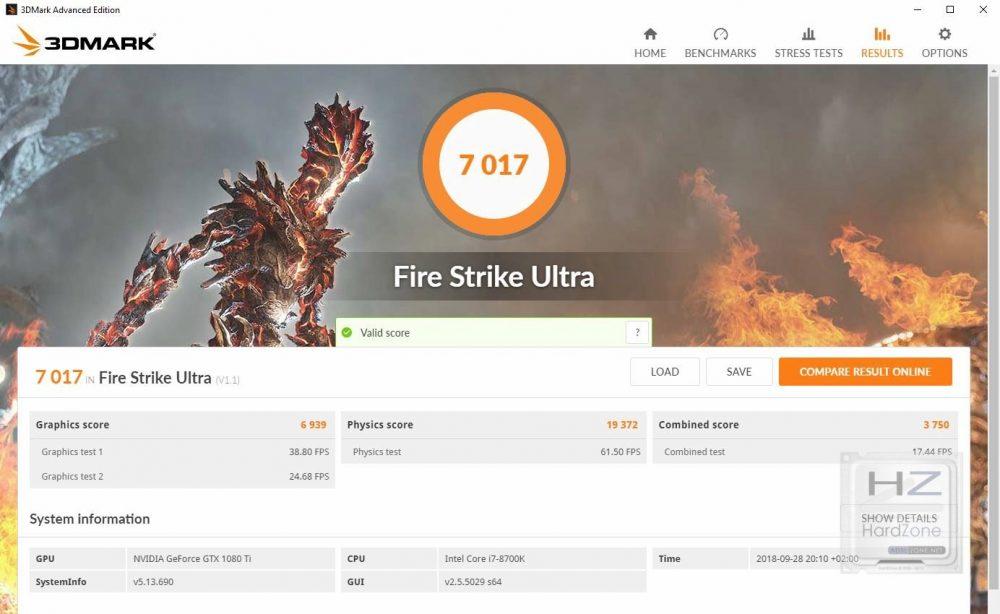

Lo comparamos con el resultado que obtuvimos con una MSI GeForce GTX 1080 Ti Gaming X:

Sinceramente esta fue la primera prueba sintética que le hice a la RTX 2080, y el resultado fue decepcionante. Generalmente, cuando NVIDIA lanza una nueva generación de tarjetas gráficas, la segunda más potente como es este caso (por debajo de la RTX 2080 Ti que analizaremos dentro de poco) suele estar a la altura de la tope de gama de la generación anterior, la GTX 1080 Ti en este caso. No obstante, como se puede ver en la prueba de 3DMark, en realidad está por debajo, bastante por debajo de hecho.

Pruebas DLSS y Ray Tracing

NVIDIA nos envió algunas demos para poder ver de primera mano DLSS y Ray Tracing, pero la parte mala es que eran simplemente eso, demos. Esto significa que pudimos probar y ver de primera mano qué tal se ven estas dos nuevas tecnologías plasmadas en la pantalla y en un entorno «real», y lo entrecomillamos porque realmente estamos hablando de softwares que no están en la calle, sino que han sido creados específicos para estas nuevas tecnologías. No hace falta que os contemos lo impresionantes que se ven las imágenes porque ya hay decenas de artículos al respecto… se ve muy bien, pero el rendimiento se ve tremendamente penalizado.

No obstante, la prueba Asteroids sí que nos daba un resultado real, y de igual manera a como indicamos en la sección de Overclock con NVIDIA Scanner, nos va a servir como punto de partida y como referencia para futuras pruebas.

Pruebas en juegos: Battlefield 1

Ahora sí, vamos a lo que más le interesará a la mayoría, los juegos. En este caso, lamentablemente no hemos podido probar la gráfica en el elenco habitual de juegos por falta de tiempo, pero al menos tenemos dos de los juegos más interesantes del panorama actual como son Battlefield 1 y Shadow of the Tomb Raider, y lo hemos hecho tanto en resolución Full HD como en Ultra HD.

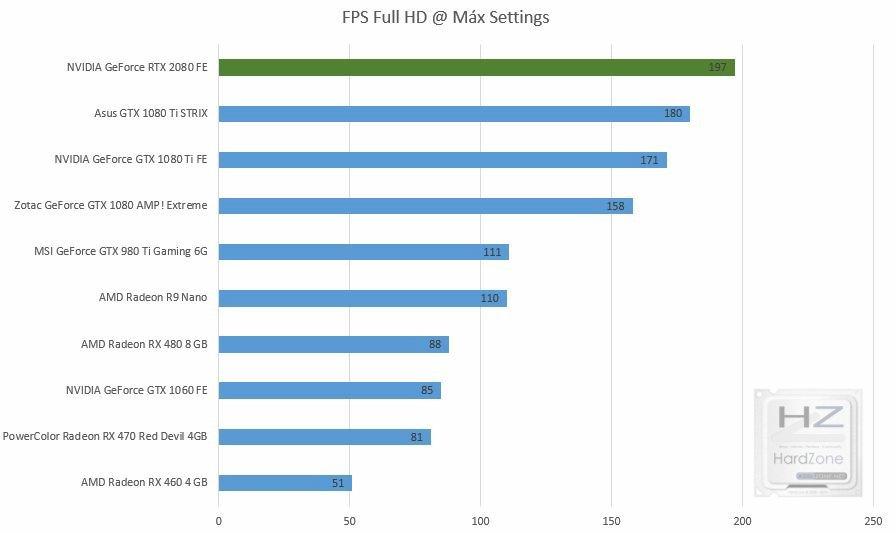

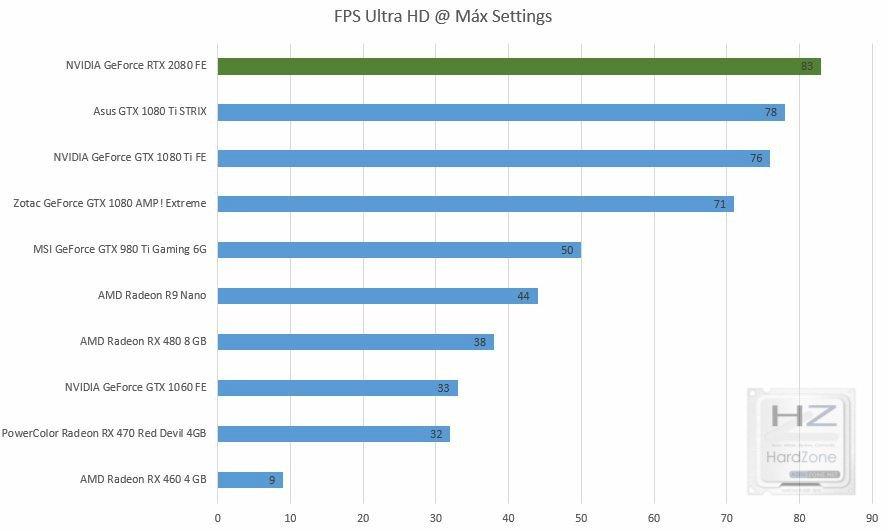

En las siguientes gráficas podéis ver el rendimiento en FPS medios medidos con la utilidad de Benchmarking de FRAPS en Battlefield 1, en todos los casos con todos los ajustes gráficos al máximo.

En este caso, y al contrario de lo que la prueba en 3DMark nos daba a ver, la RTX 2080 se ha puesto a la cabeza tanto a resolución Full HD como Ultra HD, entregando un rendimiento sobresaliente incluso a máxima resolución y con todos los ajustes gráficos al máximo.

Pruebas en juegos: Shadow of the Tomb Raider

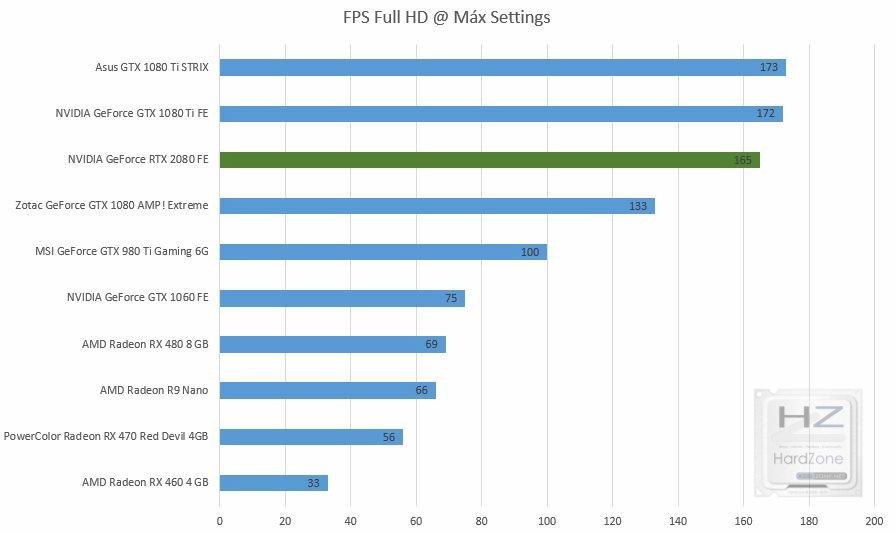

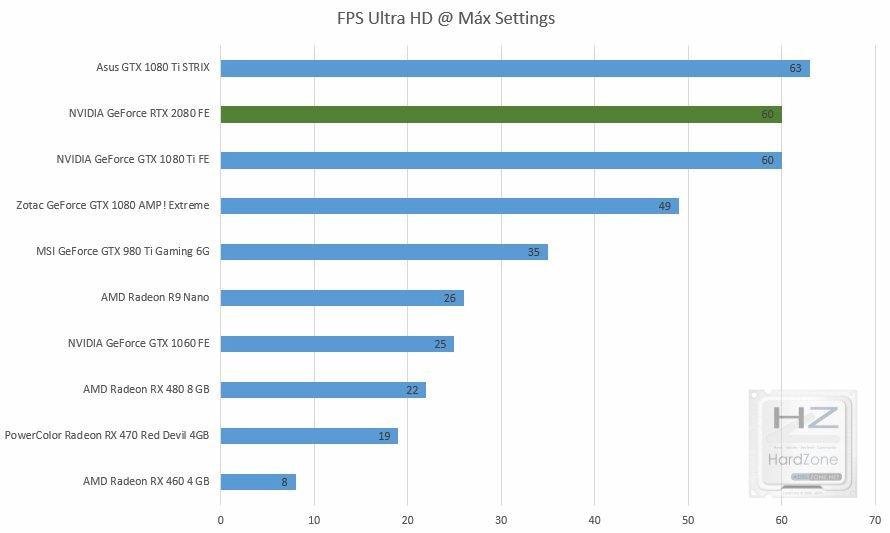

En las siguientes gráficas podéis ver el rendimiento en FPS medios medidos con la utilidad de Benchmarking de FRAPS en Shadow of the Tomb Raider, en todos los casos con todos los ajustes gráficos al máximo (salvo Ray Tracing para que la comparativa sea fidedigna). Hay que decir que con Ray Tracing habilitado, el rendimiento de la RTX 2080 FE en resolución Ultra HD ha obtenido 23 FPS de media.

En este caso, el rendimiento de la GeForce RTX 2080 ha quedado por debajo de la GTX 1080 Ti, incluyendo la Founders Edition, denotando por una parte falta de optimización -algo que solucionarán en el futuro con mejoras en los drivers- y por otra, que actualmente no sale rentable invertir en esta generación pues la anterior nos entrega el mismo o más rendimiento por mucho menos dinero.

Conclusión

La NVIDIA GeForce RTX 2080 Founders Edition que hemos analizado en el día de hoy es una tarjeta gráfica en la que el fabricante ha puesto todo su esfuerzo y años de desarrollo de ingeniería para proporcionar la última tecnología a los usuarios de a pie. No obstante, y en términos de la vida real, es una tecnología que todavía está en pañales; será el futuro, pero todavía no es el presente, tanto por falta de compatibilidad como de optimización. Tened en cuenta además que incluso para poder instalar los controladores GeForce 411.70 WHQL necesitaréis la última actualización de Windows 10, obligatoriamente.

Dejando esto de lado, como punto a favor hay que decir que sí se ha notado una evolución en el diseño, y esto empieza por el nuevo disipador que incorpora esta Founders Edition, muchísimo más eficiente y, sobre todo, silencioso. La gráfica se mantiene a unas muy buenas temperaturas en todo momento y con un nivel de ruido muy aceptable, incluso cuando sometemos a la gráfica a máxima carga.

Sí, la RTX 2080 nos entrega un rendimiento muy decente, pero bastante por debajo de lo esperado y de lo que debería si la comparamos con la GTX 1080 Ti, de igual precio, pues no olvidemos que esta Founders Edition que hemos analizado hoy tiene un precio en la web del fabricante de 849 euros. Actualmente, no es una inversión que merezca la pena para la gran mayoría de usuarios, máxime teniendo en cuenta que todavía tenemos en tiendas la anterior generación a unos precios bastante decentes y que nos van a dar un rendimiento similar, o incluso superior en el caso de las 1080 Ti.

PROS:

- Nuevas tecnologías Ray Tracing y DLSS.

- Muy buen disipador, buenas temperaturas y nivel de ruido.

- Buena calidad de materiales y construcción.

- Buen rendimiento, aunque por debajo de lo esperado.

- Overclock muy sencillo de realizar.

CONTRAS:

- Muy cara (849€), especialmente para lo que nos ofrece en términos de rendimiento.

- Necesitas la última versión de Windows 10 incluso para instalar los drivers.

- Tecnologías punteras, pero en pañales. Tendremos que esperar años para verlas estandarizadas.

Por todo ello, esta GeForce RTX 2080 Founders Edition de NVIDIA se lleva nuestro galardón de Oro.