La siguiente arquitectura de los Xeon de Intel, va a traer varias novedades interesantes a nivel de arquitectura. Si hace unos días os hablamos de extensiones en el hardware de cara a acelerar la ejecución de algoritmos de inteligencia artificial, hoy os traemos la noticia de que Sapphire Rapids va a tener soporte para memoria HBM, la cual tradicionalmente relacionamos con GPUs no integradas.

El uso de memoria HBM en CPUs para centros de datos no nos debería extrañar, ya tenemos algunos ejemplos como el A64FX de Fujitsu, pero es la primera vez que lo vemos confirmado en una CPU de alto rendimiento bajo ISA x86-64.

No olvidéis que este Intel Sapphire Rapids no es el procesador que vais a encontrar en vuestras tiendas más cercanas como si lo serán Rocket Lake y Alder Lake, pero hay que tener en cuenta que la tecnología se suele probar e implementar primero en mercados más experimentales y pequeños.

Memoria HBM en Intel Sapphire Rapids

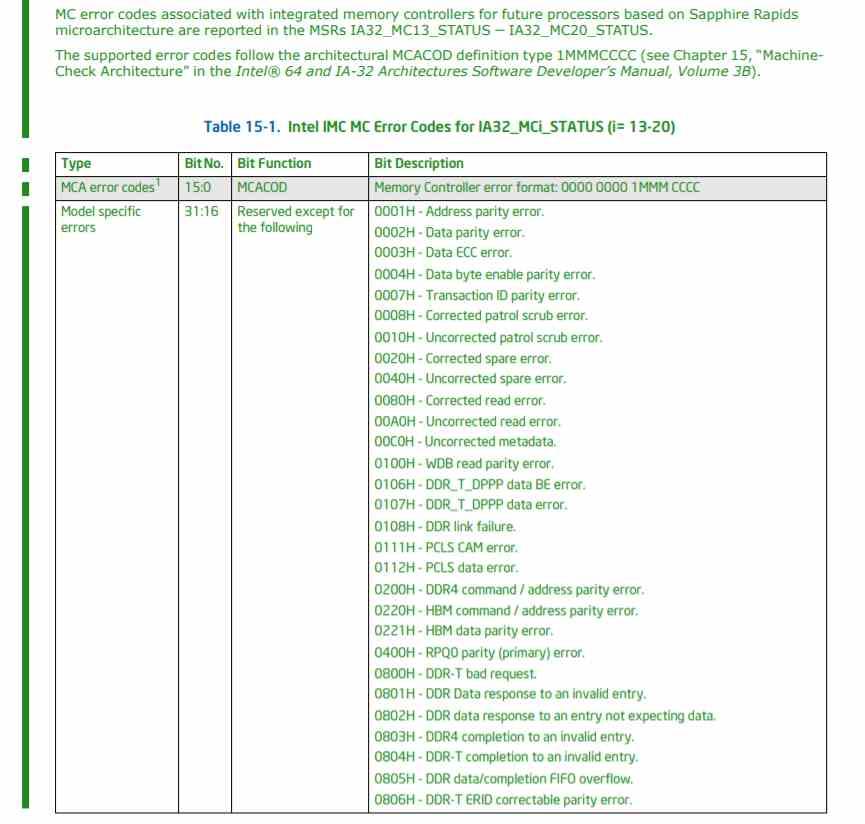

En el capitulo 15 del documento de Intel titulado Set Extensions and Future Features Programming Reference se puede ver la tabla de arriba, la cual corresponde a los códigos de error del procesador relacionados con la interfaz o controlador de memoria, es decir, la pieza del procesador que comunica con la RAM externa y en ella podemos ver referencias al uso de memoria HBM.

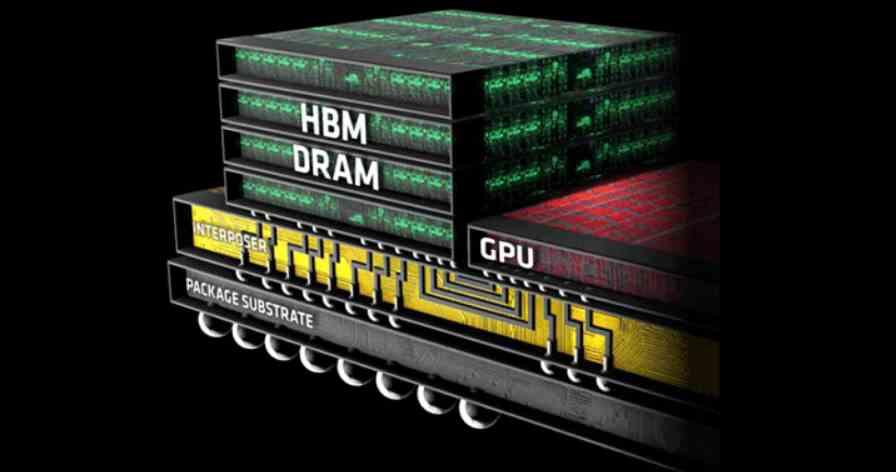

Dado que la memoria HBM requiere para funcionar estar montada encima de un interposer en común con el procesador, esto significa que Intel va a vender modelos de Sapphire Rapids en que se va a incluir en un mismo empaquetado lo que es la CPU y la RAM del sistema sin capacidad de ampliar esta última, eso si, con un ancho de banda enorme en comparación, un consumo energético mucho más bajo y ocupando mucho menor espacio.

¿Qué es la memoria HBM?

La memoria HBM es un tipo de memoria RAM que consiste en su versión más extendida de 4 chips de memoria apilados, los cuales se comunican verticalmente con un interposer, para la comunicación se utilizan vías a través del silicio que atraviesan verticalmente los diferentes chips. La comunicación no se hace horizontalmente sino verticalmente, esto permite aumentar enormemente la cantidad de pines de comunicación y que estos funcionen a menos velocidad de reloj y voltaje.

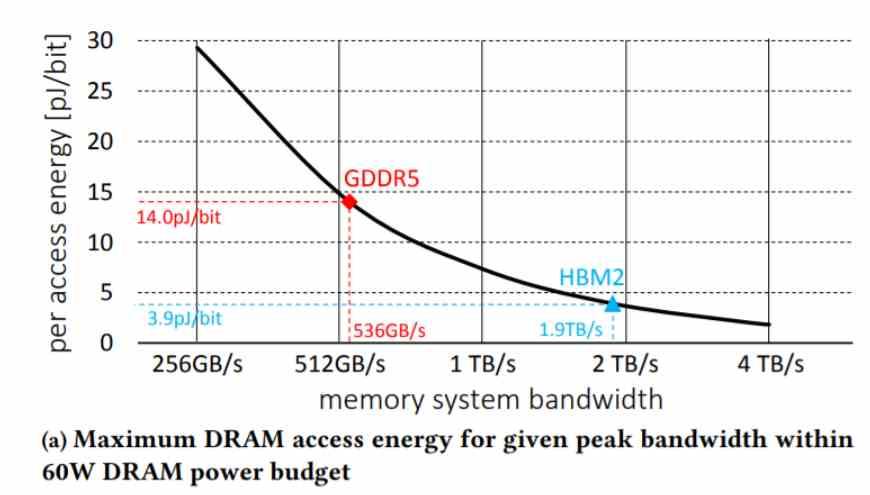

Gracias a sus características la memoria HBM tiene un consumo mucho menor cuando transfiere datos que la memoria DDR convencional y derivados como la GDDR. Pero su uso comercial es limitado por el hecho que el alto coste de producción de este tipo de memoria es muy alto, esto la ha relegado al mundo de la computación de alto rendimiento o HPC, mercado al que obviamente Intel lanzará su Sapphire Rapids con memoria HBM.

La utilidad de la memoria HBM más allá de las GPUs

Solemos asignar mentalmente la memoria HBM como un tipo de VRAM, el motivo es que lo hemos visto funcionar en tarjetas gráficas de AMD y NVIDIA, ya que esta memoria da un enorme ancho de banda como las GDDR, pero es una memoria cuya naturaleza la hace ideal para complejos sistemas multinúcleo

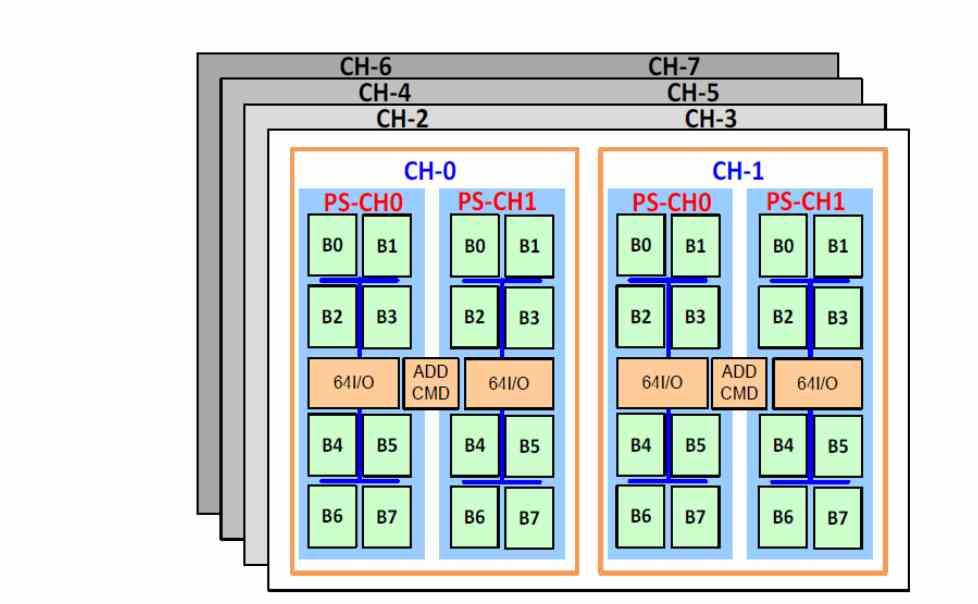

Pero la HBM tiene una particularidad y es que cada uno de los 4 chips de la pila en realidad tiene 2 canales de acceso distintos, esto son 8 canales de acceso y por tanto estamos hablando de 8 núcleos que puedan acceder al contenido de la RAM al mismo tiempo. Esto es el equivalente a tener 8 canales DDR4 al mismo tiempo, pero sin la necesidad de tener 8 DIMMs para acceder a la memoria, los cuales consumirían mucho más y ocuparían un espacio mucho mayor en placa

Teniendo en cuenta a que todo apunta que Intel va a añadir un array sistólico, es decir, un procesador para la IA, en Sapphire Rapìds entonces tiene todo el sentido del mundo que hayan versiones de este procesador con memoria HBM con tal de sacar el máximo rendimiento a la hora de ejecutar esa clase de algoritmos.