Las configuraciones duales en cuanto a tarjetas gráficas desaparecieron ya hace bastante tiempo del mercado y tenemos muy claro que no van a volver de la forma en lo que lo hicieron anteriormente. Si bien el futuro es el de las GPU por chiplets o compuestas por varios chips. Técnicamente, el hecho de tener 2 tarjetas gráficas para jugar en el PC es una estupidez.

El uso de 2 tarjetas gráficas funcionando en tándem lo podemos recordar de la era en la que la difunta, pero mítica 3Dfx lanzo sus Voodoo 2, luego en modelos posteriores esto se convirtió en diseños multichip. ¿El concepto? Se basaba en la Scanline Interleaving o SLI donde cada línea de escaneo en el monitor CRT se dibujaba por una de las dos tarjetas 3D. Años más tarde NVIDIA resucito el acrónimo bajo el nombre de Scalable Link Interface, pero esta vez cada tarjeta gráfica se encargaba de un fotograma distinto, de tal manera que cuando una terminaba el fotograma le pasaba el testigo a la otra. En el caso de AMD, ellos no se quedaron atrás y crearon su propia versión del concepto a la que llamaron Crossfire. A día de hoy ambas están olvidadas y no por casualidad.

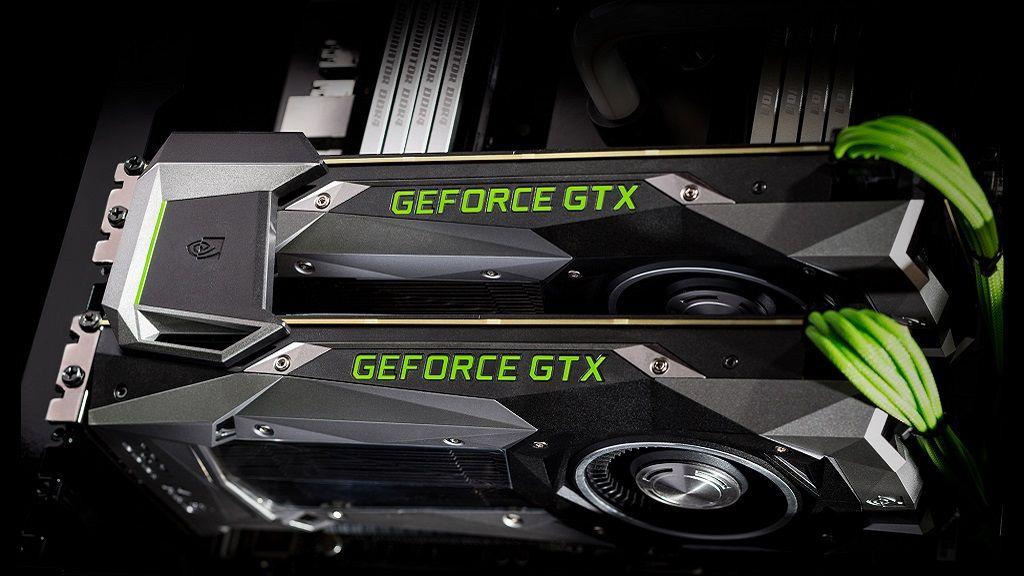

Tener 2 tarjetas gráficas no da más rendimiento en juegos

Para entender el problema que tienen las tarjetas gráficas duales hemos de entender que el código del juego ha de ser explícito acerca de cuándo empieza un fotograma en una tarjeta gráfica y cuando empieza el siguiente. El problema es que el coste en tiempo de cada fotograma no es el mismo para todos, por lo que puede ser que un frame cueste más que otro, por lo que una configuración dual no siempre se llegará al doble de rendimiento. Y, por cierto, tanto SLI como Crossfire requerían configuraciones simétricas para funcionar, es decir, ambos modelos tenían que tener la misma configuración y velocidad.

En principio no debería haber ningún problema al usar una tarjeta gráfica dual en los juegos, el problema viene cuando nos encontramos que en el código de los juegos ha de marcar explícitamente en que tarjeta gráfica se ha de ejecutar cada frame. ¿Qué ocurre? Pues que muy poca gente tenía configuraciones así y no había incentivo en llevar a adaptar los juegos. Si a esto le sumamos que SLI y Crossfire funcionaban distinto y requerían ser programados por separado, entonces queda muy claro porque el soporte para 2 tarjetas gráficas acabo desapareciendo en los juegos de PC.

Es por ello que usar 2 tarjetas gráficas en un ordenador ha pasado a ser un sinsentido de cara a los juegos. No hay mercado, y, por tanto, no hay títulos que lo aprovechen. Sin embargo, hemos de aclarar que a día de hoy existen muchos sistemas con doble hardware gráfico, dado que muchos procesadores de Intel y AMD disponen de una gráfica integrada, pero por los motivos que ya os hemos comentado no funcionan en tándem y en consecuencia cuando una se activa la otra se desconecta por completo, es decir, no suman su potencia.

Las GPU para juegos del futuro serán duales

Sin embargo, no tardaremos en ver no dobles tarjetas gráficas, sino tarjetas gráficas con dos o más GPU interconectadas entre sí colocadas en su circuitería. Por ejemplo, AMD tiene una patente para un futuro diseño donde tarjetas gráficas se unifican en una sola. En el sentido de que tenemos dos chips gráficos o GPU en combinación con una memoria en común. Sin embargo, lo importante de dicha tecnología es que AMD ha conseguido que de cara a las aplicaciones se comporte como una tarjeta gráfica convencional, ya que es el primer chip el que se encarga de controlar los tiempos del segundo de manera automatizada.

No hay dudas de que NVIDIA e Intel habrán desarrollado una solución similar, no obstante, por lo que sabemos, sus RTX 40 continuarán estando de una pieza y, por tanto, no estarán compuestos por chips separados. Dado que estos chips son cada vez más grandes en complejidad y los costes aumentan con el tamaño de los chips, vamos a ver como las configuraciones se disgregaran en varios chips distintos. La primera en hacerlo serán las RX 7000, pero no con una configuración dual, aunque lo hará separando el controlador de memoria, algo que ya hemos visto en sus procesadores Ryzen.