La existencia de las CPU Intel Xeon basadas en la arquitectura Sapphire Rapids con HBM2E no son realmente una noticia, ya que desde hace meses que conocíamos su existencia, pero no habíamos visto hasta ahora una imagen de este procesador para servidores de Intel cuyo mercado objetivo no es otro que el mundo de la inteligencia artificial y sus disciplinas basadas en el aprendizaje automático.

No hay duda que todas las variantes de la High Bandwidth Memory son el tipo de memoria ideal, a excepción de su precio, por el hecho de que ocupan poco espacio, consumen poco por dato transmitido y tienen una latencia mucho más baja que las memorias DDR5 y GDDR. Esto último es gracias al uso de un interposer sobre el cual se ha de instalar tanto el procesador como la memoria HBM.

Intel Xeon Sapphire Rapids con memoria HBM2E

Esto hace que el precio de crear una CPU o una GPU con este tipo de memoria sea mucho más caro, además en que el caso de una CPU limita enormemente las capacidades de expansión al no poder ampliar la RAM.

Hasta el momento no habíamos visto memorias del tipo HBM fuera de las GPU para la computación de alto rendimiento como son las AMD Instinct y las NVIDIA Tesla, no obstante, Intel tiene en la recámara procesadores Intel Xeon Sapphire Rapids con este tipo de memoria y por fin hemos podido ver la primera imagen de uno de ellos.

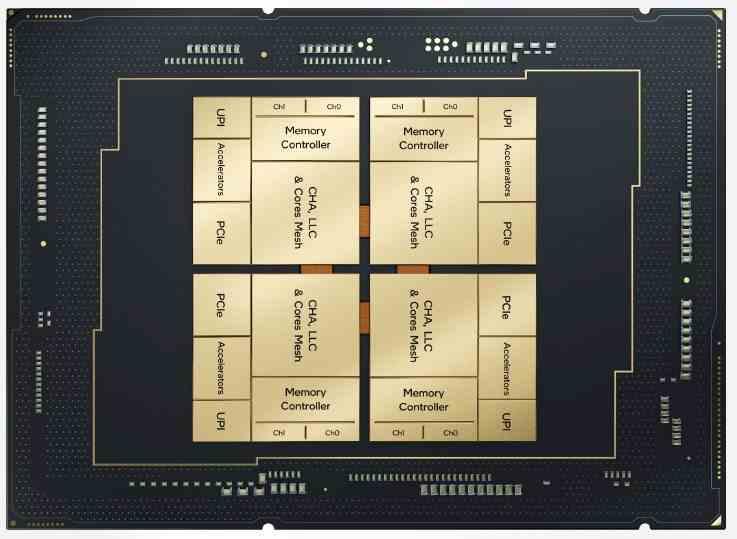

Lo primero que hemos de recordar es que las CPU para servidores que Intel lanzará en 2022 estará compuesta no por una pieza única o monolítica sino por varias intercomunicadas entre sí a través de un interposer común.

Esto se hace por el hecho que cuanto más grande es un chip a la hora de fabricarse más porcentaje de fallos hay a medida que su tamaño crece y además, existe actualmente un límite en el tamaño. Dividiendo la circuitería en chips más pequeños se pueden crear procesadores combinados que vayan más allá del límite de un chip único y obtener así más chips buenos por oblea.

Hasta 80 Cores y ¿previsión de más?

Pero el uso de la memoria HBM2E en el caso de Sapphire Rapids se debe a la inclusión de las unidades AMX entre las unidades de ejecución de cada uno de los núcleos y que como su nombre indica están pensadas para el cálculo con matrices tan típicas en algunos algoritmos de inteligencia artificial. Este tipo de unidades para funcionar hacen uso de colecciones de datos muy grandes y es por ello que requieren memorias con un ancho de banda más grande que la DDR, como es el caso de la HBM2E.

Y tal y como se puede ver, Intel ha creado un Intel Xeon Sapphire Rapids compuesto de 8 tiles, algo que no nos esperábamos desde el momento en el que el modelo estándar es de 4. A cada tile le corresponde una interfaz HBM2E de 2048 bits, lo cual le permite comunicarse con dos chips de este tipo de memoria, siendo cada uno de 1024 bits y albergando cada uno una pila de 4 u 8 chips de DRAM. ¿El ancho de banda que le proporcionará? 3,68 TB/s en total, aunque solo para una capacidad de 128 GB.

Además de estos datos, el rumoreado recuento de 56 núcleos para la versión de más alta gama se elevará hasta 80 núcleos, lo que sumado con una frecuencia mayor y sobre todo con un salto de IPC mayor podría igualar por primera vez desde la salida de los AMD EPYC la balanza en servidores, ya que los del equipo rojo planearían aumentar el recuento a 96, ¿será suficiente?