Nvidia y Microsoft están desarrollando un acelerador de cálculos para IA

El fabricante de núcleos gráficos Nvidia se ha aliado con el gigante del software Microsoft para comenzar a desarrollar el nuevo acelerador de cálculos bajo el nombre HGX-1 que se integrará en los servidores hiperescalares de los centros de datos para así crear un nuevo camino más rápido y flexible para las aplicaciones que hacen uso intensivo de la inteligencia artificial, un campo que todavía está bastante en pañales pero que con este nuevo dispositivo se espera que produzca grandes resultados.

HGX-1 hace para las cargas de trabajo de la inteligencia artificial que se hayan basadas en la nube lo que el estándar ATX – Advanced Technology eXtended – hizo para placas base de los ordenadores personales cuando fue introducido hace más de dos décadas. Establece un estándar de la industria que puede ser rápida y eficientemente adoptado para ayudar a satisfacer la creciente demanda del mercado. La nueva arquitectura está diseñada para satisfacer la creciente demanda de computación basada en inteligencia artificial en la nube, en campos como la conducción autónoma, la atención médica personalizada, el reconocimiento de voz sobrehumana, el análisis de datos y vídeo y las simulaciones moleculares en diversos campos de la medicina y la química.

La inmersión de Nvidia en la industria de la inteligencia artificial ha sido un gran éxito para esta compañía. Durante el trimestre anterior, el segmento de estaciones de trabajo del fabricante reportó un incremento en los ingresos del 145% con respecto al año fiscal anterior. En el cuarto trimestre de 2008, el mercado de los centros de datos registró ingresos de $93.000 millones y durante el cuarto trimestre del año fiscal 17, estos ingresos alcanzaron los $296.000 millones, lo que es una hazaña impresionante para una compañía en este segmento de mercado y su inversión en tarjetas gráficas de alto rendimiento dedicadas a acelerar AI, DNN y las tecnologías de computación en la nube realmente está pagando fuertes dividendos para el equipo verde.

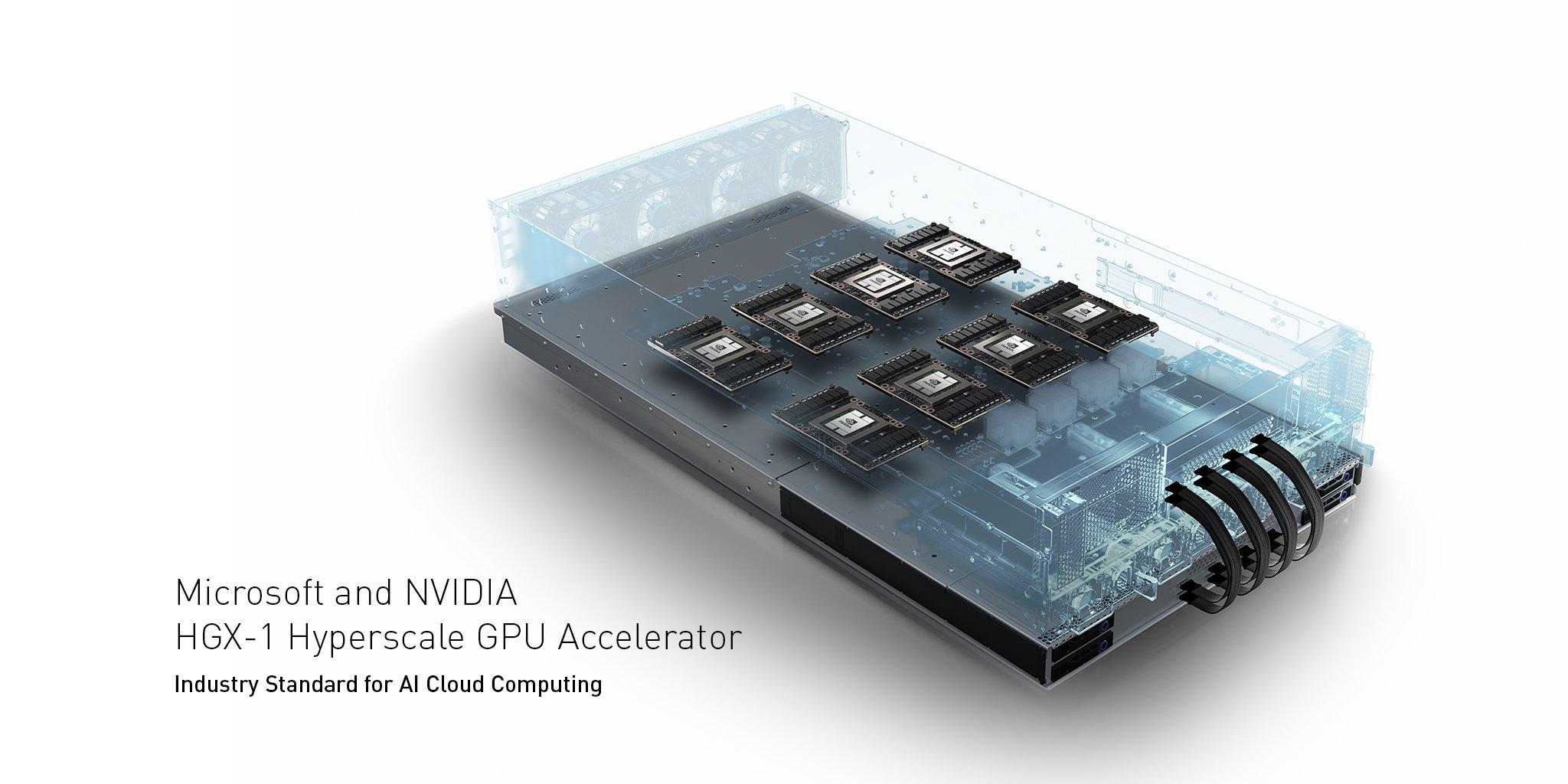

Equipada con ocho tarjetas gráficas Nvidia Tesla P100 en cada chasis, cuenta con un innovador diseño de conmutación basado en la tecnología de interconexión NVLink y en el estándar PCIe, permitiendo que un proceasdor se conecte dinámicamente a cualquier número de tarjetas gráficas. Esto permite que los proveedores de servicios en la nube que monten en sus equipos la infraestructura HGX-1 sean capaces de ofrecer a los clientes una muy amplia gama de configuraciones en sus máquinas.

Las cargas de trabajo en la nube son más diversas y complejas que nunca. El entrenamiento de IA, la inferencia y las cargas de trabajo HPC se ejecutan óptimamente en diferentes configuraciones del sistema, con un procesador conectado a un número variable de GPUs. El diseño altamente modular del HGX-1 permite un rendimiento óptimo sin importar la carga de trabajo. Proporciona hasta 100 veces un rendimiento de aprendizaje profundo en comparación con los servidores basados en modelos de procesadores anteriores, y se estima en un quinto del costo de la formación de IA y una décima parte del costo de la inferencia de IA.