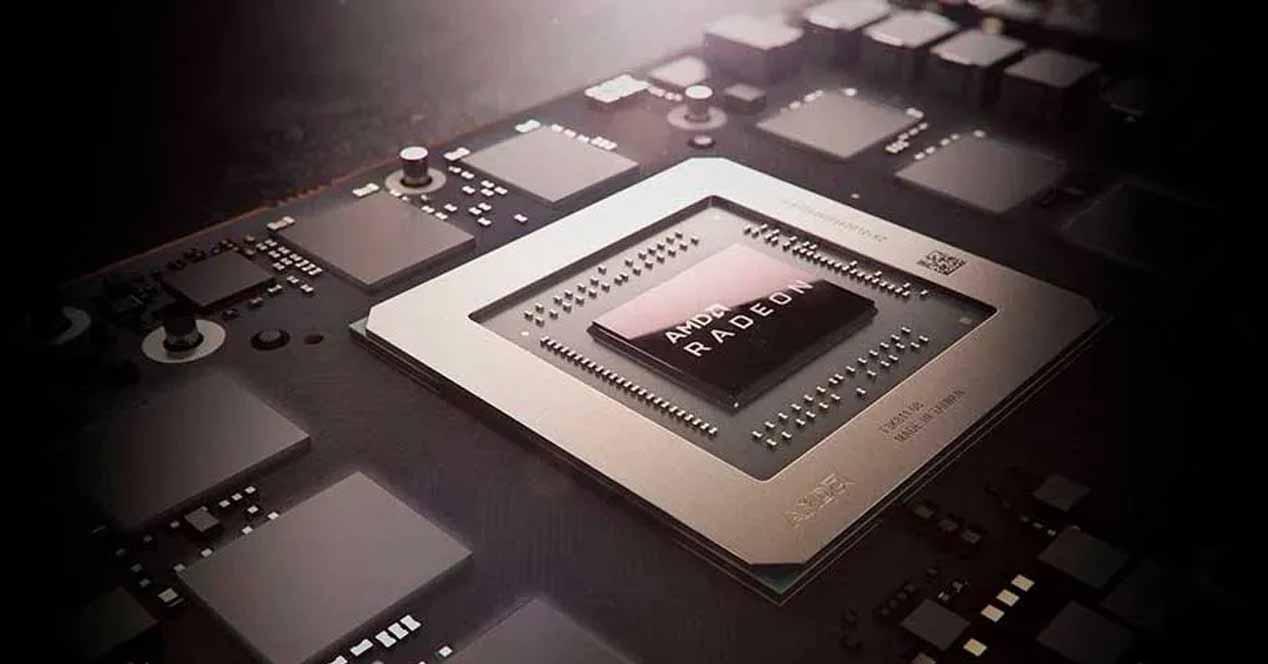

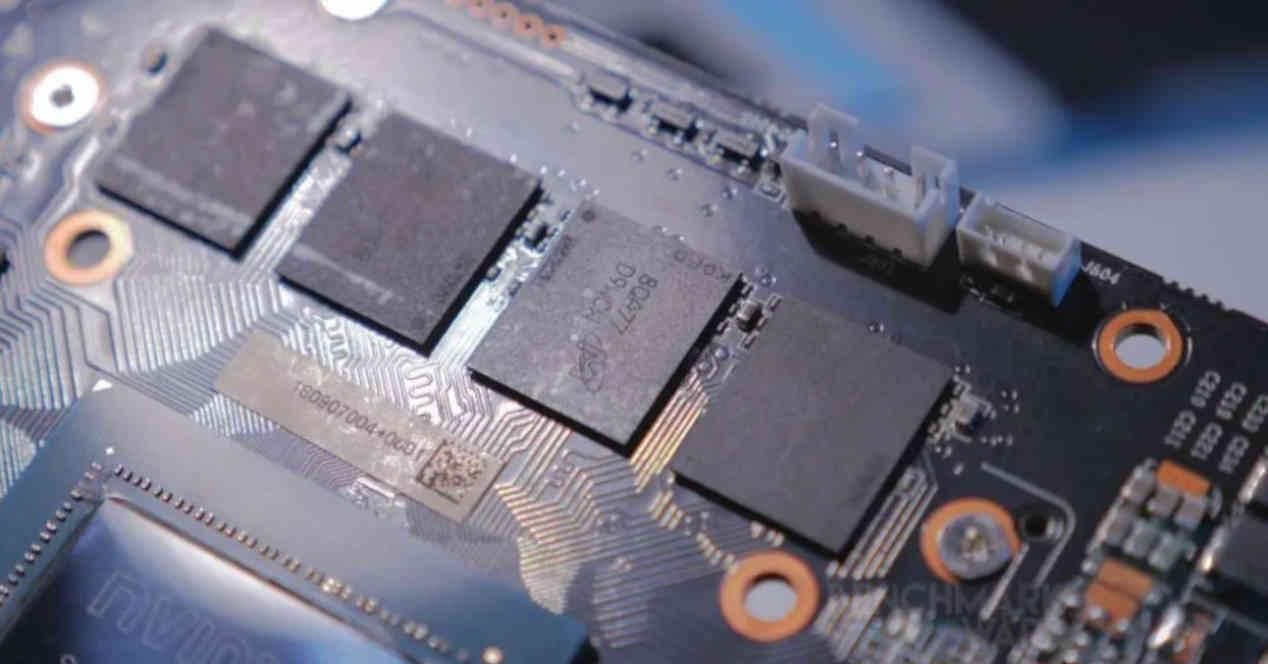

Todas las tarjetas gráficas traen, aparte de la GPU que es el chip principal, una serie de chips de memoria. Este es un hecho incontestable y lo puede llegar a apreciar cualquiera. En dicha memoria se almacenan los datos de operaciones y de texturas, necesarios para el desarrollo de su función con normalidad. Sin embargo, a lo largo de los años se han usado muy diferentes tipos de memoria VRAM en esta función. Desde la antigua SDRAM, hasta la más moderna GDDR. Sin olvidarnos de la HBM que usan algunas tarjetas gráficas de gama alta. Veamos cuáles han sido los diferentes tipos de memoria empleados.

Si tienes un PC con tarjeta gráfica dedicada seguramente sepas cuánta memoria dedicada tiene y de qué tipo es (por ejemplo, 6 GB GDDR6), así que la VRAM no será un concepto que te suene a chino. En este artículo vamos a hablarte no de qué es esta memoria ni qué características tiene, sino que vamos a contarte un poco de su historia, que siempre es interesante saber un poco más.

¿Qué es la VRAM?

Desde las primeras terminales basadas en pantallas de televisión que usamos memoria RAM para almacenar el búfer de imagen, es decir, el siguiente fotograma que se mostrará en pantalla. Sin embargo, lo que conocemos como VRAM o RAM de vídeo fue un invento de la segunda mitad de los 80, el cual se lo debemos a Texas Instruments. ¿La idea? Una memoria de doble canal en el que hardware gráfico y procesador pudieran acceder al mismo tiempo en los sistemas con memoria unificada.

Su primer uso en PC fue con las tarjetas gráficas MCGA del IBM PS/2, posteriormente rebautizadas como VGA, y permitió no solo que la CPU tuviese acceso a la VRAM durante el periodo de dibujado en pantalla, algo que antes no se podía. Si no, también implementar elementos como el doble búfer y un acceso al mismo tiempo por parte del controlador de pantalla.

A día de hoy llamamos bajo las siglas de VRAM a toda memoria RAM que es usada por las tarjetas gráficas. Sin embargo, hemos de aclarar que no es el tema de las integradas en procesadores desde el momento en que utilizan la RAM del sistema. Caso distinto en el caso de las consolas de videojuegos donde utilizan este tipo como memoria única del sistema compartida entre CPU y GPU.

Optimizada en velocidad de transferencia, no en latencia

El objetivo de toda VRAM es dar el mayor caudal de datos, es decir, dar el mayor ancho de banda posible, aunque sea a través de aumentar la latencia de datos o el tiempo que la memoria le responde al procesador una petición. Es por este motivo que el consumo medio de este tipo de memoria suele ser mucho más alto que la RAM normal. A día de hoy una de las causas más importantes en cuanto al aumento de consumo en las tarjetas gráficas.

Y no lo decimos por decir, por ejemplo, la memoria GDDR6X consume 8 *10-12 Joules por bit que multiplicados por el ancho de banda nos da la potencia en vatios que consume dicha RAM. No es mucho más alta en esa cifra que la DDR5, pero cuando ves que una funciona a 4.8 Gbps y la otra a 21 Gbps, entonces la cosa ya cambia y se puede entender el alto valor de consumo energético y de calor liberado por la VRAM, de ahí que los disipadores de las tarjetas gráficas sean tan grandes y no reduzcan su área solamente a lo que es el chip gráfico.

Tipos de VRAM a través de la historia

En las tarjetas gráficas no siempre se ha usado memoria de vídeo especializada en las tarjetas gráficas, hubo periodos en los que independientemente de que la VRAM ya existiese se usaron memorias RAM de propósito general, como es el caso de la EDO RAM, la SDRAM e incluso varios sabores de la DDR, es por ello que nos centraremos en las memorias de vídeo que han aparecido a lo largo del tiempo.

Memorias VRAM para la era CRT

Los monitores basados en la tecnología de tubo de rayos catódicos funcionaban distinto a los actuales LCD, en cada línea de escaneo, el controlador de pantalla leía del búfer de imagen donde se encontraba la siguiente línea de escaneo para convertir la información. Esto significaba que las memorias de vídeo tenían que tener no dos canales de acceso, sino tres; sin embargo, existía una pequeña trampa que consistía en que aparte de la memoria DRAM existía dentro de la VRAM una pequeña memoria SRAM que no llegaba ni a un Kilobyte de memoria muchas veces y que era donde se copiaba la información de la siguiente línea de escaneo.

El otro punto importante era que antes de la llegada de la VRAM era que durante el tiempo de generación de pantalla no se podía manipular la memoria de vídeo, si se hacía se acababan generando artefactos de imagen nada agradables a los ojos del usuario. Es por ello que estas fueron las primeras memorias de doble canal. Por un lado, el accesible por la CPU y por el otro lado el del chip gráfico. Sin embargo, el procesador no podía acceder a la parte de la memoria que perteneciese a la línea de escaneo que se estaba dibujando en ese momento.

En dicha época se usaron todo tipo de memorias en tarjetas gráficas, no solo VRAM y su versión mejorada, la SGRAM, las cual era una variante de la SDRAM, Dicho tipo de memoria tenía incorporado dicha memoria búfer en su interior, para poder enviar la información de forma directa a la salida de vídeo.

La llegada de las tarjetas 3D lo cambio todo

Las primeras tarjetas para generar gráficos 3D a tiempo real tenían que lidiar con un problema, el del overdraw, pese a que el espectador no lo veía, un pixel en pantalla podía ser dibujado varias veces por el hecho que por aquel entonces no existía el descarte de polígonos no visibles. Esto provoco que las exigencias subieran por las nubes, luego de cara a la lectura para el filtraje de texturas la tasa de relleno se multiplicó por 4. Por lo que la VRAM tuvo que evolucionar para no convertirse en un cuello de botella.

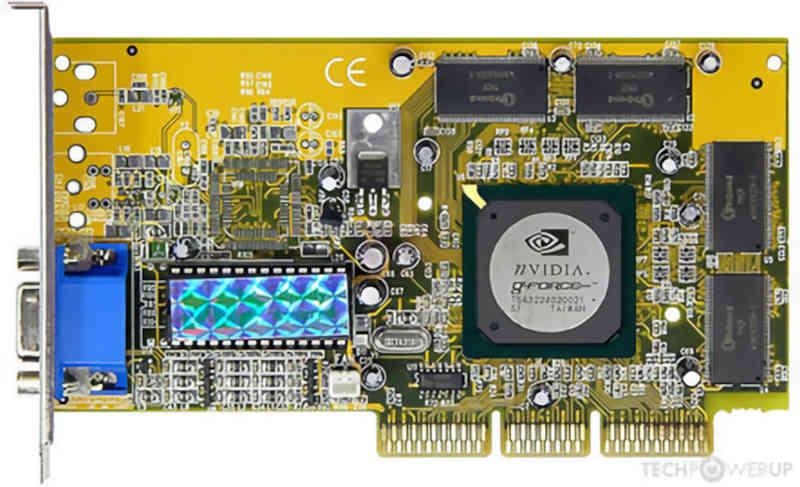

La primera Voodoo Graphics tenía una memoria de vídeo a una velocidad de 800 MB/s, tres años después, la GeForce DDR había dado el salto a los 4800 MB/s. Un salto seis veces superior. A medida que ha ido pasando el tiempo hemos ido viendo como la capacidad en ancho de banda de la llamada GDDR ha ido creciendo generación tras generación. ¿Y qué es la GDDR exactamente? Pues memoria SDRAM. A medida que ha ido pasando el tiempo, las necesidades en el ancho de banda han ido creciendo, esto ha hecho que la memoria de vídeo haya evolucionado más que ninguna en dicho aspecto.

El motivo de ello es sencillo, en los gráficos en 3D, a diferencia de los que son en 2D durante la creación de una imagen, un mismo punto en la pantalla puede ser escrito varias veces por frame, lo que aumenta la necesidad de ancho de banda, ya que vamos a estar transmitiendo muchos más bits desde la GPU hacía la VRAM, a dia de hoy en el orden de decenas.

La evolución de memoria GDDR

La GDDR ha tenido un total de 6 generaciones hasta el momento que se han encontrado como VRAM en las tarjetas de video, todas ellas han mantenido los principios de la SGRAM, desde el momento en que dicha memoria es realmente DDR SGRAM, por lo que hereda las características de este tipo de memorias que es lo que las diferencia de las DDR convencionales para PC. Desde el año 2000 en que lanzó la primera tarjeta gráfica con dicha memoria, la GeForce DDR, hasta día de hoy ha ido evolucionando generación tras generación de tarjetas gráficas y de memorias.

¿La trampa para ello? Usar el avance de los nodos de fabricación para poder bajar los voltajes y llegar más fácilmente a ciertas frecuencias, en todo caso, os dejamos una tabla en la que podéis ver la evolución de las memorias GDDR para tarjeta gráficas:

| Tipo | Gbps por bit | Voltaje | Capacidad del chip |

|---|---|---|---|

| GDDR | 0.8 | 2.5 V | 64 MB |

| GDDR2 | 1.6 | 1.8 V | 128 MB |

| GDDR3 | 3.6 | 1.5 V | 256 MB |

| GDDR5 | 7 Gbps | 1.5 V | 1 GB |

| GDDR5X | 13.75 Gbps | 1.5 V | 1 GB |

| GDDR6 | 24 Gbps | 1.35 V | 2 GB |

| GDDR6X | 28.75 Gbps | 1.35 V | 2 GB |

Sin embargo, y antes de finalizar una serie de puntualizaciones sobre la tabla:

- Para calcular el ancho de banda tenéis que multiplicar la cifra en Gbps por la cantidad de bits que tenga vuestra tarjeta gráfica y luego dividirlo entre 8 para tener la velocidad en GB/s.

- Si no sabéis como hacerlo, contar la cantidad de chips de memoria en la placa, cada uno de ellos son 32 bits.

- La tabla da máximos en lo que al tamaño de las diferentes VRAM del tipo GDDR se refiere.

Con esto ya tenéis todo lo básico necesario sobre memoria RAM que utiliza tu tarjeta gráfica.