Continuando con el hilo del artículo sobre Stephen Hawking acerca de la inteligencia artificial (IA) que publicamos hace meses, el físico Elon Musk (co fundador de empresas como Paypal o Tesla Motors) ha dicho que «La IA puede provocar el día del juicio final, pero sé cómo evitarlo«.

No cabe duda de que la Inteligencia Artificial ya forma parte de nuestras vidas. Poco a poco se ha ido integrando en ella y casi sin darnos cuenta convivimos con ella con total naturalidad. Hablamos de ordenadores capaces de tomar decisiones en función de diversas circunstancias (para los programadores, los condicionales), los asistentes de voz (Siri, Cortana…) que interpretan lo que les decimos y nos responden en consecuencia, etc. Pero la IA va mucho más allá. En esta web os hemos hablado en ocasiones de que esta tecnología cada vez está más desarrollada, hasta el punto de que ya hay «robots» capaces de aprender o de repararse a sí mismos.

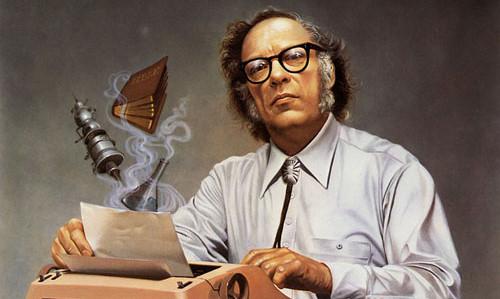

Ya el reputado físico teórico Stephen Hawking entre otros dijo que la IA sería el peor error de la humanidad, pero todavía estábamos a tiempo de intentar evitar el desastre. Lo hemos visto en libros como «Yo, Robot» de Asimov, e incluso en las célebres películas de la saga «Terminator» o «Matrix», donde las máquinas han evolucionado a un nivel tal que deciden que ya no necesitan al ser humano y pueden valerse por sí mismas. Y de hecho hay muchos personajes que afirman que «el momento de la IA llegará».

Tras el reciente estreno de la última película de la saga Terminator, Elon Musk nos ha recordado lo importante que es «mantener a raya a la IA», es decir, que la humanidad debe ser capaz de definir una serie de reglas y límites que la IA jamás deba poder sobrepasar. Efectivamente, algo parecido a las tres leyes de la robótica de Isaac Asimov.

Esto que os estamos contando puede parecer paranoico o fuera de lugar, pero nada más lejos de la realidad. Estamos creando «seres» con inteligencia propia, y puede llegar el día en el que efectivamente decidan que ya no necesitan al ser humano para subsistir. Y no es tontería. Ya existe un «instituto del futuro de la vida» encargado de estos temas, y en el que colaboran celebridades (tanto económica como activamente) como Morgan Freeman, Stephen Hawking o Elon Musk. Mirad qué cuadro.

La IA nos facilita la vida, de eso no hay duda. Pero también hay que tener cuidado y establecer unos límites (de hecho ya existe un acuerdo entre Google, Microsoft y Facebook entre otras empresas para delimitar qué puede y qué no puede hacer la IA de sus sistemas). Estamos avisados. Tanta gente brillante no puede estar equivocada al mismo tiempo…

Fuente propia, idea tomada de Xataka.