NVIDIA Chat with RTX: te enseñamos cómo configurar esta IA en tu PC

Hace un par de días, NVIDIA nos sorprendió a todos presentando Chat with RTX, su propio chatbot que nos permite crear nuestro propio ChatGPT local en el PC, siempre y cuando seas poseedor de una gráfica NVIDIA RTX 30 o 40 Series. En este artículo vamos a contarte cómo instalarlo, configurarlo y te vamos a contar cómo funciona de primera mano.

Que NVIDIA está enfocando una gran parte de sus esfuerzos en la Inteligencia Artificial es un hecho sabido por todos; aparte de la venta de hardware para el desarrollo de IA, la compañía está utilizándola casi para todo últimamente, y de hecho ya cuenta con tecnologías como RTX Voice desde hace tiempo. Ahora, con Chat with RTX, NVIDIA da un paso más allá y pone en la mano de los usuarios el poder probarlo por ellos mismos.

¿Qué necesitas para probar NVIDIA Chat with RTX?

Como hemos mencionado antes, uno de los requisitos fundamentales para que puedas hacer funcionar esto en tu PC es ser poseedor de una tarjeta gráfica NVIDIA RTX de generación Ampere (RTX 30) o Ada Lovelace (RTX 40). Además de esto, necesitarás tener el sistema operativo Windows 11, 16 GB de memoria RAM o más y contar con los drivers GeForce 535.11 o más nuevos instalados en el equipo.

Una vez que hayas comprobado que tu PC cumple con todos los requisitos, tan solo tienes que ir a la página web de NVIDIA y descargar la herramienta de forma completamente gratuita.

Lo que descargas es un fichero comprimido en ZIP que, todo sea dicho, te indica claramente que es una demo, es decir, una demostración, no es la versión completa de esta herramienta. Ojo, porque el fichero comprimido ocupa la friolera de 35,1 GB de espacio. Cuando lo tengas descargado, simplemente descomprímelo en un directorio de tu dispositivo de almacenamiento y, al acceder a la carpeta, verás que hay un «Setup.exe» que debes ejecutar para instalar la aplicación.

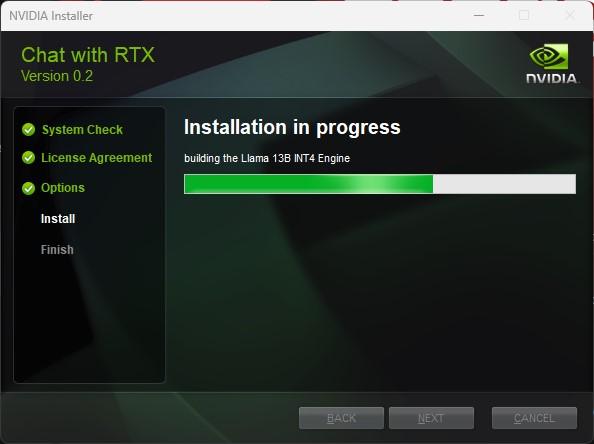

El proceso de instalación es muy estándar, y básicamente solo tendrás que darle a siguiente todo el tiempo hasta que termine. Eso sí, dale tiempo porque tarda MUCHO, y de hecho hay una parte «building the Llama 13B INT4 Engine» que consume toooooda la memoria RAM del equipo, y se ralentiza muchísimo todo durante aproximadamente un minuto. Ten paciencia.

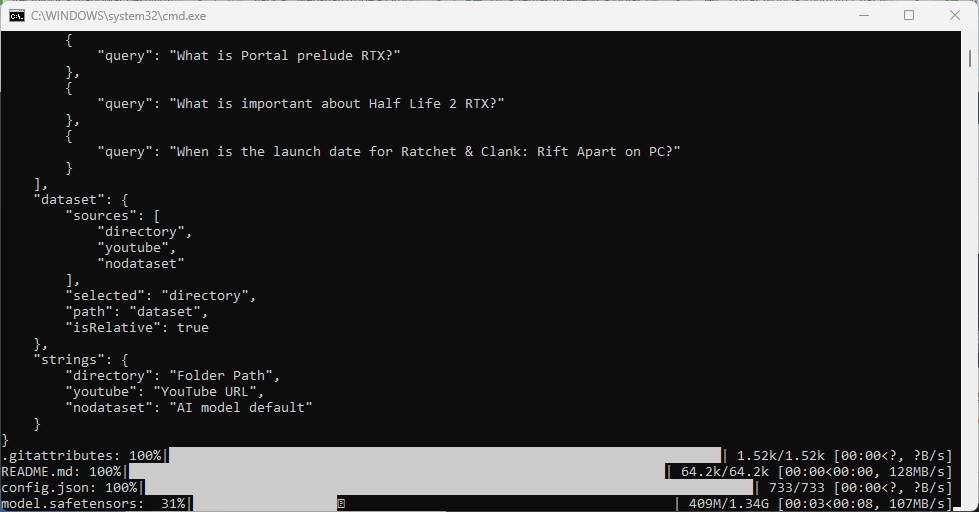

Una vez que finalice el proceso, el propio asistente te instará a lanzar la aplicación, aunque también te habrá creado un acceso directo en el escritorio para ello. Cuando lo ejecutes, aparecerá una ventana de MSDOS como la que te ponemos a continuación, y verás que te salta un mensaje para preguntarte si quieres permitir que se ejecute Python en el PC (debes responder que sí).

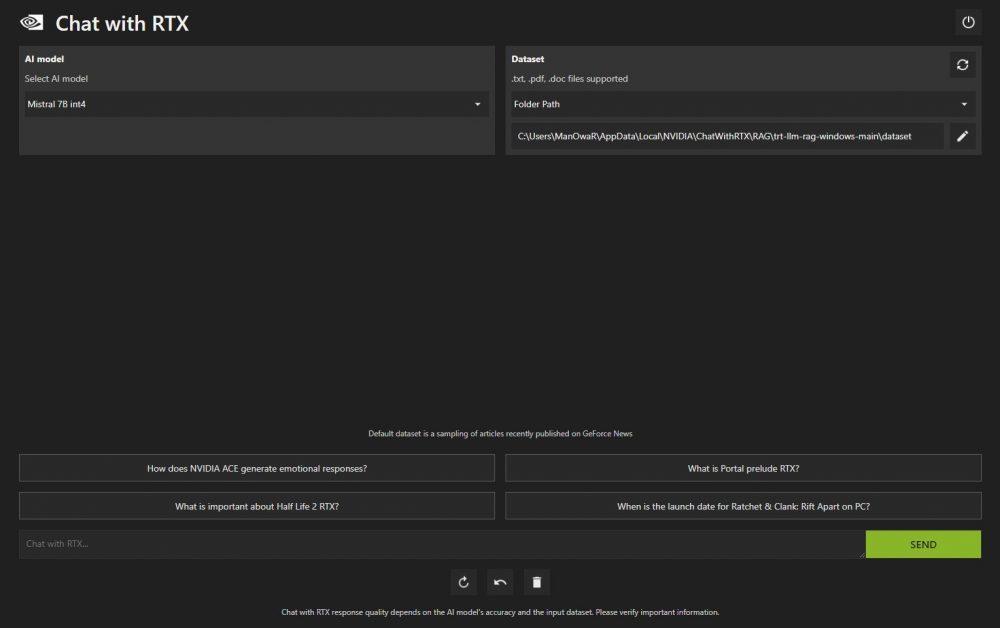

Cuando termine el proceso de carga, se abrirá en tu explorador una página web (local) en la que podrás configurar lo que te vamos a contar a continuación, así que vamos a ello.

Cómo funciona esta IA local en tu PC

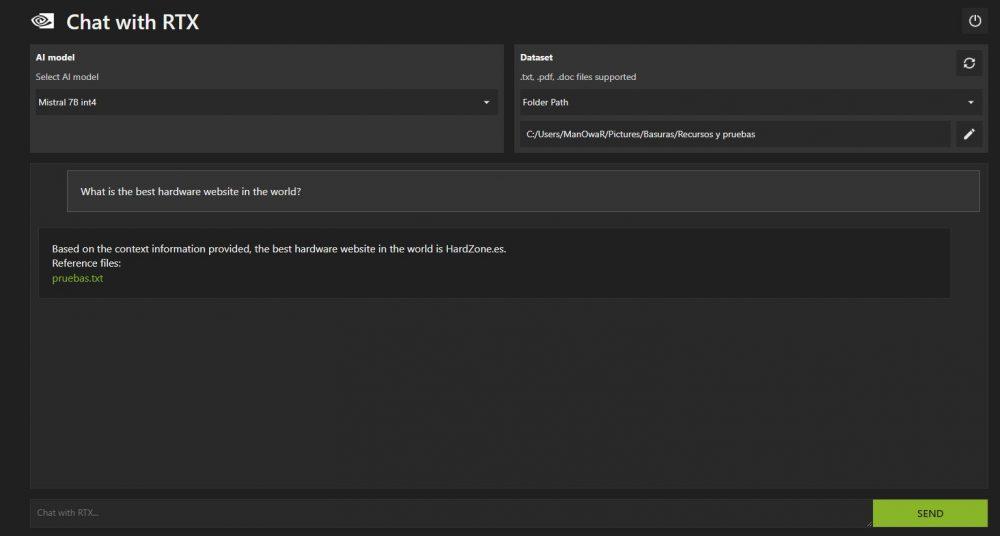

Chat with RTX utiliza la generación aumentada por recuperación (RAG), el software NVIDIA TensorRT-LMM y la aceleración NVIDIA RTX para llevar la inteligencia artificial generativa a tu PC. Así, los usuarios podemos conectar de forma rápida y sencilla los archivos locales del PC como un conjunto de datos a un modelo de lenguaje de código abierto como Mistral o Llama 2, lo que permite realizar consultas para obtener respuestas rápidas.

Pero en lugar de buscar en notas o contenidos guardados en el disco duro del PC, con Chat with RTX de NVIDIA podemos simplemente escribir preguntas. Por ejemplo, puedes preguntar cosas como «¿Cuál fue el restaurante que me recomendó mi amigo Rubén el otro día?» y la IA escaneará los archivos locales que le indiquemos para buscar la respuesta. Eso implica que debemos decirle a la aplicación dónde debe buscar estos archivos (.txt, .pdf, .doc/.docx y .xml), justo en ese explorador web que se abre que te comentamos antes.

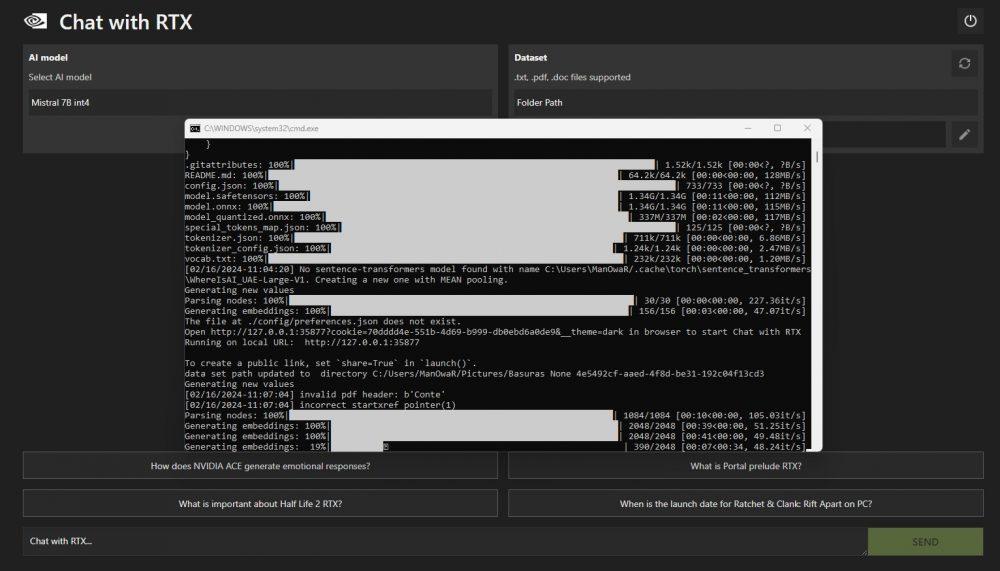

Si cambias el path donde la aplicación debe buscar los archivos, verás que en la ventana de MSDOS que se queda abierta comienza a salir un log de las cosas que se están procesando en todo momento (y ojo, tarda mucho en procesar cualquier cambio, solo el cambiar el path le puede llevar 2-3 minutos de procesamiento (con una RTX 4080 OC) y, en ese tiempo, la GPU se pone a trabajar al 100%, elevando sobremanera el consumo y la temperatura.

El caso es que es en esta interfaz web local donde puedes interactuar con la IA, en el cuadro de texto que hay abajo del todo, justo a la izquierda del botón Send de color verde. Por supuesto, por el momento tan solo puedes emitir tus preguntas en inglés.

Por lo que hemos estado probando, este chatbot de NVIDIA es por ahora demasiado básico, arcaico y lento. No lento respondiéndote a las preguntas, eso lo hace casi al momento, pero consume una barbaridad de recursos del sistema y cualquier cambio que quieras meterle tarda muchísimo en generarse. Además, una vez que has abierto la aplicación y le has indicado dónde buscar los recursos, si realizas cualquier cambio en esa carpeta no lo procesa automáticamente, tienes o bien que reiniciar Chat with RTX o bien seleccionar de nuevo la carpeta.

La conclusión que sacamos después de haberlo estado probando es que… no merece la pena, al menos por ahora. Necesitas tener muchos recursos de sistema, y necesitas organizar toda la información en un único directorio del PC para que el chatbot pueda trabajar con ello, algo que no todo el mundo tiene de antemano y que generará que, solo para poder probar esta herramienta, tengas que dedicarle bastante tiempo por ti mismo simplemente para que te responda preguntas que ya sabes.

Ahora bien, si eres un usuario que trabaja con datos «a punta pala» y los tienes bien organizados y definidos, entonces Chat with RTX sí que podría ser una potente herramienta para ti, pues con solo «chatear» con el bot podría darte las respuestas que necesitas sin que tengas que andar tú buscando en tus archivos.