Este chatbot por IA funciona con AMD igual que Chat with RTX de NVIDIA

Prácticamente todas las semanas, nos encontramos con alguna noticia relevante relacionada con la Inteligencia Artificial demostrando una vez más que todavía tiene un largo camino por recorrer y que solo estamos en el principio.

Gracias a ChatGPT Plus, la versión de pago del chatbot más popular en todo el mundo, podemos crear nuestra propia IA con la información que queramos.

Hace unas semanas, NVIDIA presentó Chat with RTX, una aplicación que nos permite crear un chatbot personalizado que se base en un LLM que podemos entrenar con los datos que queramos y que nos permite crear una IA personalizada, siempre y cuando tengamos una RTX 30 o superior.

Si tenemos una gráfica RTX 20 ya nos podemos ir olvidando, pero ¿y que pasa por AMD? Si tenemos una gráfica de AMD, este fabricante no nos ofrece una aplicación como NVIDIA para entrenar una IA personalizada, pero si nos muestra los pasos a seguir para crearla.

Si tenemos una APU Ryzen 7000 y Ryzen 8000, modelos incluyen una NPU o una gráfica Radeon de la serie 7000, tenemos la posibilidad de crear una IA e interactuar con ella a través de un chatbot, de igual forma de que hacemos con ChatGPT, Copilot de Microsoft, Gemini de Google o cualquier otra.

Cómo crear un chatbot personalizado con una gráfica o APU de AMD

AMD ha publicado en su página web una guía con todos los pasos que debemos seguir para crear un chatbot impulsado por LLM basado en GPT, utilizando las APU y tarjetas gráficas compatibles que hemos mencionado más arriba.

Si el equipo dispone de una APU Ryzen de la serie 7000 o de la serie 8000, debemos descargar la aplicación LM Studio – Windows a través de aquí. Si, tienes una gráfica Radeon de la serie RX 7000, la aplicación que debemos descargar es LM Studio – ROCm desde aquí, una versión que todavía se encuentra en fase beta.

A continuación, ejecutamos la versión que hayamos descargado y debemos seleccionar el tipo de LLM que queremos utilizar, al igual que con Chat with RTX. Los LLM disponibles son Mistral 7b y LLAMA V2 7b, ambos nos ofrecen resultados muy similares por lo que, a no ser que tengas la necesidad de procesar muchos datos, en un principio da igual que modelo elegir.

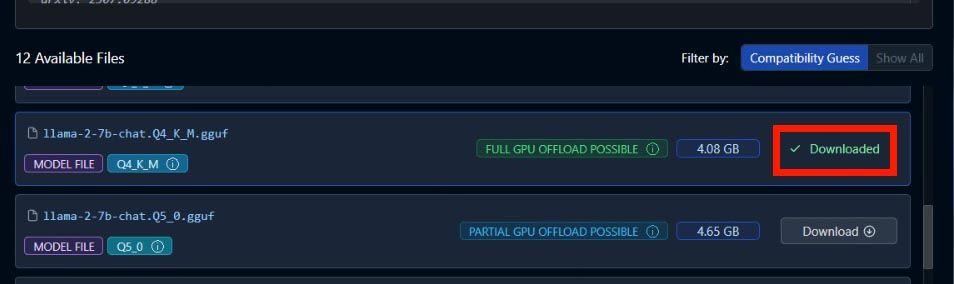

En el panel de la derecha, seleccionamos buscamos el archivo correspondiente al LLM que hemos seleccionado y descargamos el modelo Q4_K_M pulsamos en el botón Download.

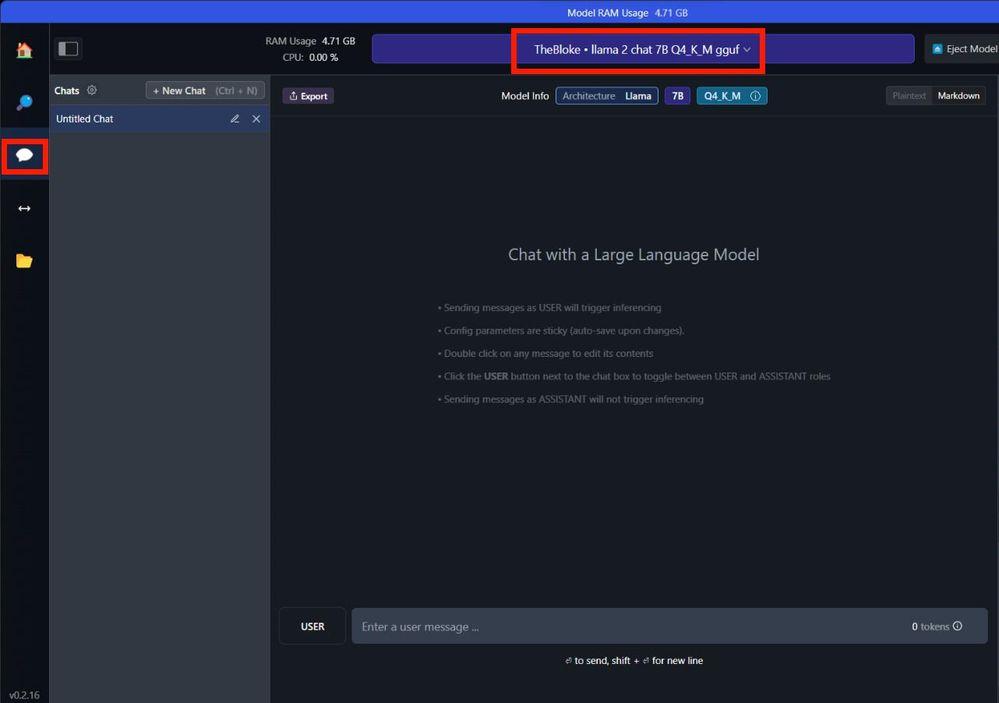

Una vez lo hemos descargado, nos dirigimos a la ventana de chat y seleccionamos el modelo de LLM que hemos seleccionado y descargado para que acabe de cargarse en la aplicación.

Si el equipo está gestionado por una APU de AMD, ya podemos comenzar a chatear con el chatbot, una vez le añadamos el contenido el contenido con el que queremos entrenar la IA.

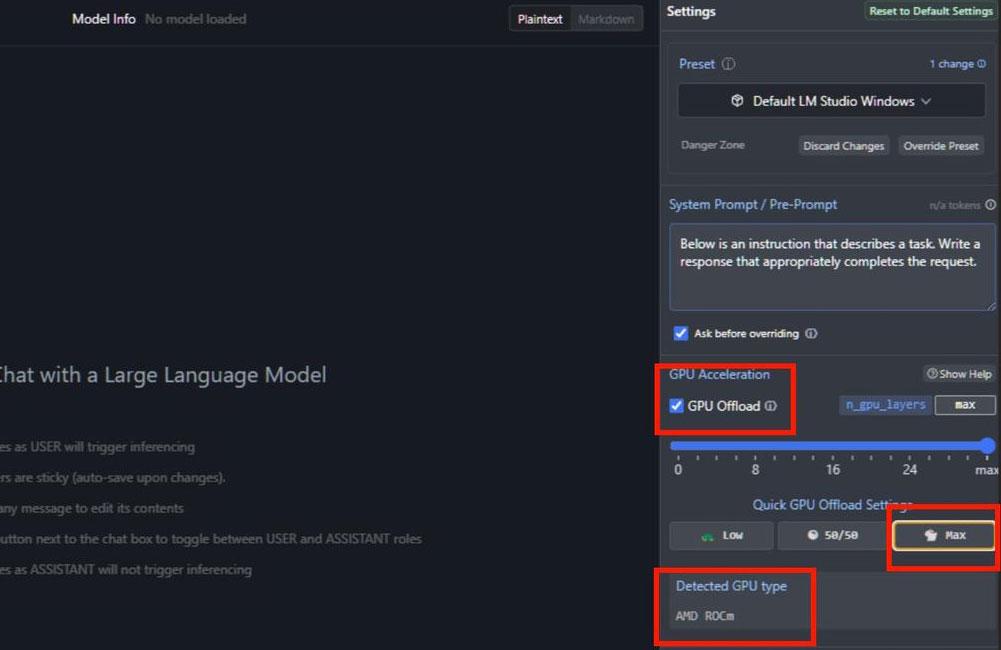

Si, en lugar de tener una APU tienes un Radeon RX 7000, tendrás que realizar unos ajustes más para comenzar a chatear. Para hacerlo, debemos desplegar el cuadro de ajustes y marcar las casillas GPU Offload y mover la barra de desplazamiento a la derecha.

Tras realizar este cambio, en Detected GPU type debe mostrarse AMD ROCm. Si no es así, o nuestra gráfica no es de la serie RX 7000 o no hemos realizado los pasos correctamente.