Los algoritmos de super resolución se han convertido en una tendencia los últimos tiempos, en especial por los problemas para conseguir construir una GPU capaz de ejecutar gráficos a 4K. Siendo los máximos exponentes por el momento el DLSS de NVIDIA y el FSR de AMD, los cuales van a continuar mejorando en los años siguientes. ¿Cuál es la siguiente evolución del NVIDIA DLSS y el AMD FSR?

A medida que vamos aumentando la resolución de salida en nuestros juegos la cantidad de píxeles aumenta, con ello el ancho de banda y la cantidad de operaciones por segundo necesarias. Las GPU se enfrentan a cuellos de botella en su diseño, los cuales no son solo el ancho de banda, sino también el tamaño de estas y el creciente consumo energético debido a ello.

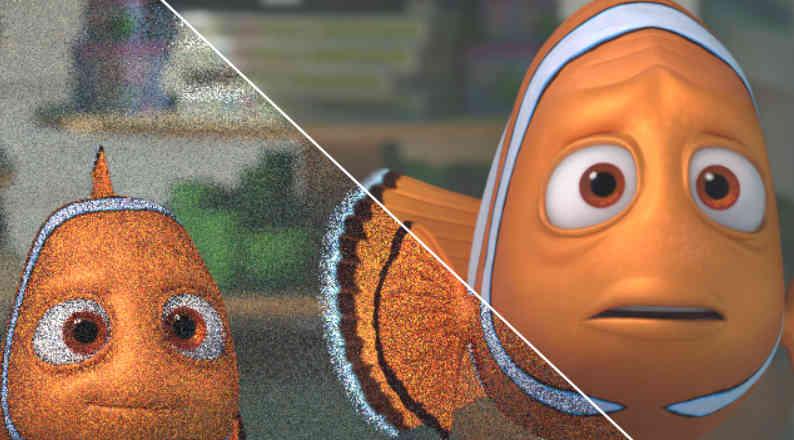

La primera en darse cuenta de ello fue NVIDIA, de ahí el desarrollo de sus Tensor Cores y algoritmos como el DLSS. La idea no es otra que renderizar a una resolución mucho menor y luego de cada fotograma producido a través de algoritmos basados en la visión por computador sacar una versión con más resolución de salida y por tanto con mayor cantidad de píxeles. Donde las predicciones de una IA bien entrenada pueden sacar una imagen extremadamente cercana a la resolución objetiva.

AMD por otro lado se ha visto forzada a crear el FSR, pensado a las limitaciones de cara a la IA de sus procesadores e ideado para recortar la ventaja que le otorga el DLSS a NVIDIA en ciertos juegos.

La evolución a futuro del DLSS de NVIDIA

Tenemos muy claro que en Lovelace, NVIDIA va a aumentar enormemente la capacidad de cálculo de sus Tensor Cores, lo que acelerará algoritmos como el DLSS, al mismo tiempo que permitirá lanzar versiones más complejas del algoritmo que aumentaran la calidad de imagen respecto a las versiones actuales del DLSS.

Pero una cosa que nos llamó poderosamente la atención en la GTC 2021 de la propia NVIDIA es la creación de entornos virtuales para la conducción automática. Muchos os preguntaréis qué tiene que ver esto con el DLSS, pero hay que tener en cuenta que estamos ante lo que llamamos visión por computador, donde le enseñamos al sistema de IA a diferenciar formas y colores básicos para que luego pueda realizar una identificación o una reconstrucción de la misma imagen pero a mayor resolución.

Uno de los objetivos de NVIDIA es reducir al máximo la necesidad de tener que entrenar la IA de los diferentes juegos, lo que ampliará la cantidad de juegos compatibles con el DLSS, pero también solucionar el problema de la imprecisión de imagen con el Ray Tracing. En especial porque el siguiente paso será la aplicación de algoritmos de Denoising a través de IA, el cual puede entrar en conflicto con los resultados del DLSS, de ahí a que el DLSS 3.0 será una unión de ambos algoritmos.

¿Y cómo sera la del FSR de AMD?

La siguiente evolución del AMD FSR es más clara que la del DLSS, no olvidemos que la versión del algoritmo de AMD no se basa en la inteligencia artificial, no obstante, tenemos pistas que nos apuntan a que AMD podría lanzar una versión 2.0 que sí que se basaría en la IA.

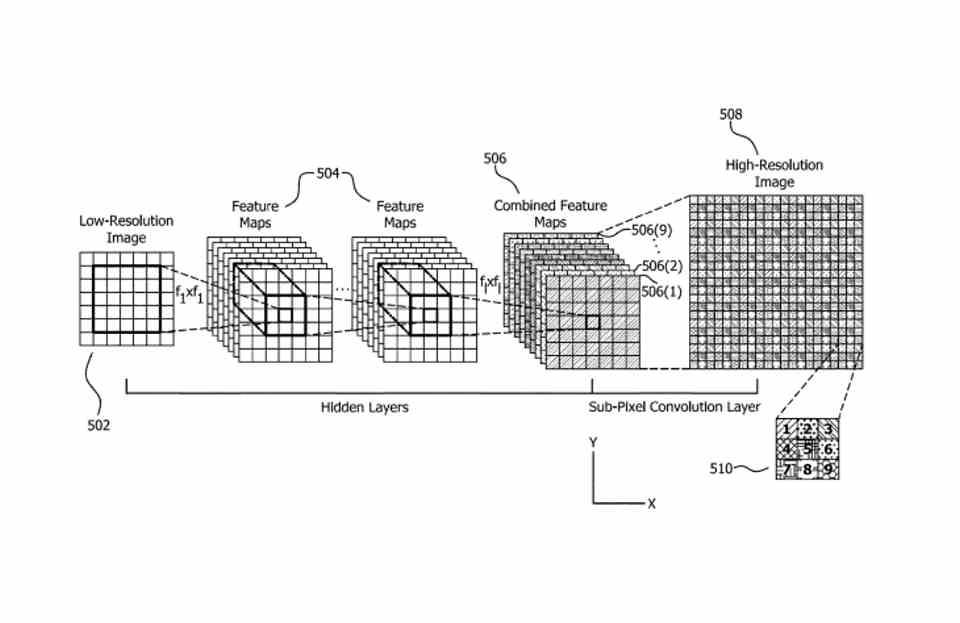

La primera de ellas es la existencia de una patente de super resolución por parte de AMD que hace uso de redes neuronales, lo que indica el añadido de este tipo de hardware en futuras GPUs de AMD de la familia RDNA. Y por tanto sería la primera vez que AMD añadiría este tipo de unidades en sus GPU Gaming.

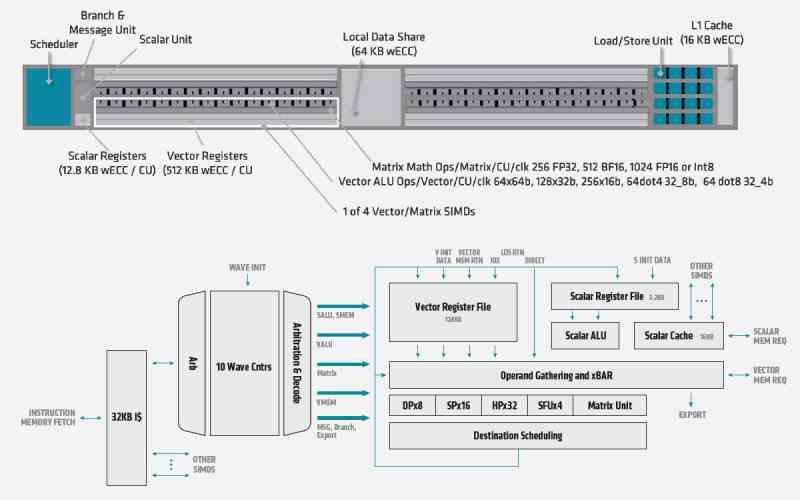

Lo cual no sería un problema para ellos desde el momento en que ya tienen una unidad de este tipo en CDNA, por lo que solo tendrían que trasladar esta unidad de las Compute Units de CDNA a las de RDNA. En todo caso el mayor reto de AMD es ponerse al día frente a NVIDIA, no solo en hardware, sino también en software, no olvidemos que el DLSS es un algoritmo en constante evolución y no se trata de algo fijo.

Por lo que la evolución del DLSS y el FSR están claras, lo que no sabemos es si AMD se pondra las pilas y se pondrá al nivel del DLSS a nivel de calidad de algoritmo o ambos caeran en el olvido por el algoritmo que está desarrollando Microsoft y que incluirá en futuras versiones de DirectX.