Era más que evidente que aun habiendo presentado ya las GTX 1080 y GTX 1070, NVIDIA se guardaba varios ases en la manga. El más evidente de todos es la GTX 1080 Ti, gráfica que utilizará el segundo “gran chip” de arquitectura Pascal de la marca: el GP102. Os contamos todo lo que se sabe sobre él.

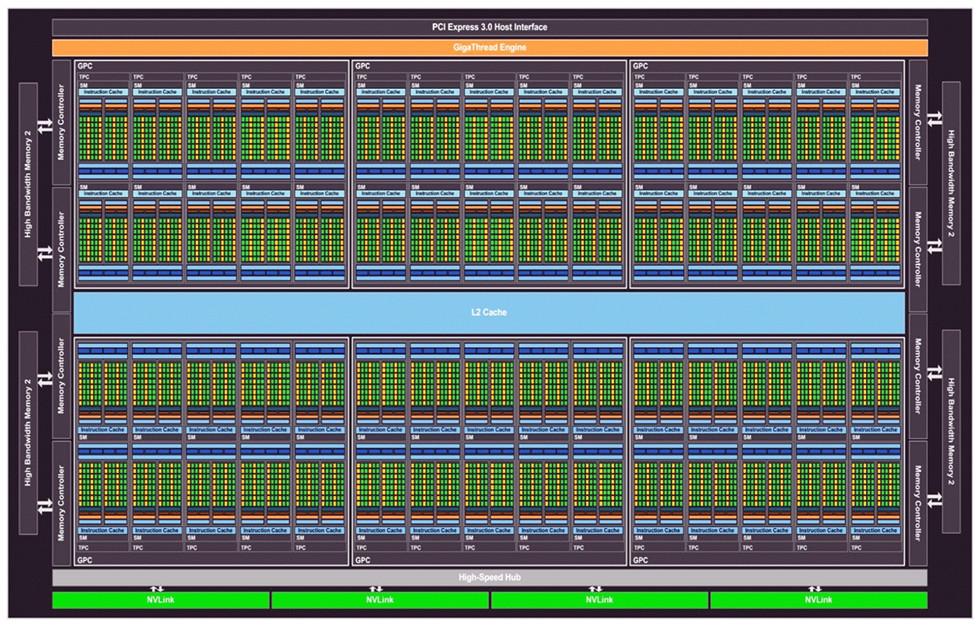

El primer “gran chip” de ésta generación es el GP100 que debutó con el chip gráfico Tesla P100. Es un chip muy caro que utiliza una combinación de núcleos FP32 (precisión simple) y FP64 (doble precisión), utilizando un total de 3840 SPFP y 1920 DPFP en total, sumando 5760 CUDA cores, casi nada. Claro que los núcleos FP64 son prácticamente inútiles para el consumidor, particularmente en las manos de un usuario que se compra una gráfica para jugar. A esto hay que sumarle que éste chip emplea una interfaz de memoria HBM2 de 4096 bits con los chips de memoria integrados en la propia GPU, algo que hace del chip todavía más caro y motivo por el que NVIDIA ha relegado éstos chips para el ámbito profesional y lanzará otras versiones basadas en éste para el consumidor de a pie.

Vale, hecha la explicación vamos a lo que más nos interesa. Por lo que parece NVIDIA no ha encontrado el término medio entre el super potente chip GP100 y el simple GP104 todavía, y es que de hecho la competencia de AMD hará imposible que los de verde puedan vender una gráfica de consumidor basada en el chip GP100 a un precio que ronde los 650 dólares.

Aquí es donde entra en juego el seguido gran chip de la marca, el GP102. Éste ASIC estará orientado al mercado de consumidor y no al profesional, es decir, para productos GeForce GTX Series que incluirá en primera instancia la NVIDIA GeForce GTX 1080 Ti. Para esto, NVIDIA ha eliminado los cores FP64 reduciendo el consumo y por supuesto el coste de fabricación, por lo que estaremos ante un chip con un total de 3840 cores FP32, un 33% más de los que tiene el actual chip GP104 (de igual manera a como el chip GM200 tenía un 33% más de núcleos que el GM204).

Ahora bien, hay debate entre los especialistas en hardware sobre qué hará NVIDIA con respecto a la memoria gráfica de la próxima GTX 1080 Ti. Los hay que están convencidos de que la marca utilizará memoria gráfica GDDR5X para abaratar todavía más el coste y sacarle un mayor partido a ésta tecnología, dejando la memoria HBM2 para el verdadero tope de gama (la próxima GTX Titan, lógicamente, una gráfica que ya solo por su nombre NVIDIA venderá a buen seguro por encima de los 1500 euros).

Vía | WCCFTech.