La memoria HBM (High Bandwidth Memory) se anunció a bombo y platillo en el pasado como una alternativa muy superior a la memoria GDDR en tarjetas gráficas, pero resultó ser bastante fiasco y solo AMD llegó a implementarla en productos comerciales, abandonándola después. Sin embargo, en los últimos tiempos NVIDIA parece bastante empeñada en este tipo de memoria, y de hecho sus principales socios para su implementación (Samsung, Micron y SK Hynix) parecen también convencidos de que es el futuro.

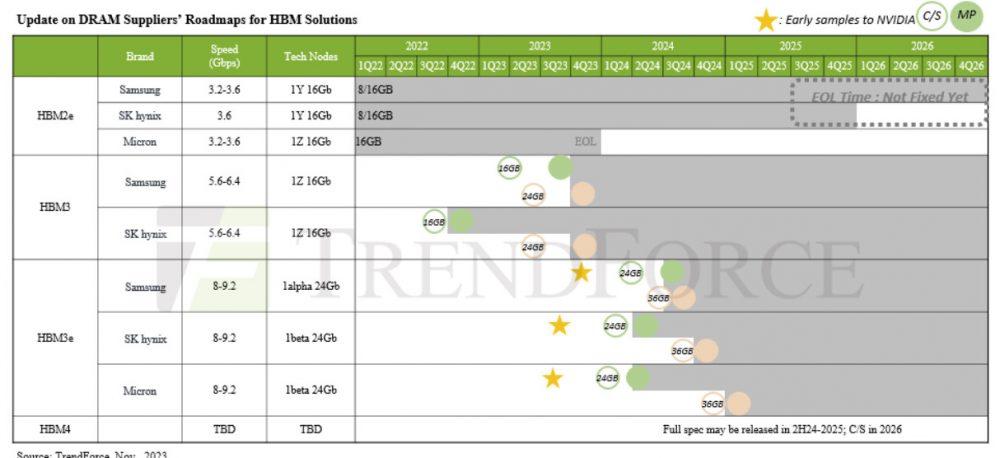

Tanto es así que según Trendforce, NVIDIA está planeando diversificar sus proveedores de memoria HBM para poder tener una cadena de suministro más sólida y eficaz. De esta manera, se prevé que la memoria HBM3 de Samsung finalice su verificación con NVIDIA en diciembre de este año, mientras que Micron Technology ya suministró los primeros chips de HBM3e a NVIDIA a finales de julio. Por su parte, SK Hynix lo hizo a mediados de agosto y Samsung a principios de Octubre.

Con estos datos en la mano, parece claro que NVIDIA está muy pero que muy interesada en implementar HBM.

NVIDIA trabaja duro para implementar la memoria HBM

El proceso de verificación que tiene que hacer NVIDIA de la memoria HBM no es para nada sencillo, y se estima que le llevará al fabricante al menos medio año el tenerlo todo listo. Trendforce especula con que los resultados preliminares para la memoria HBM3 estarían listos a finales de este mismo año, pero en general lo lógico sería que los fabricantes de chips de memoria HBM tengan el visto bueno de NVIDIA en el primer trimestre de 2024. Estos resultados serán determinantes para que NVIDIA decida cuál será su proveedor final.

Hay que tener en cuenta una cosa, y es que NVIDIA también está muy enfocada últimamente en la Inteligencia Artificial y sus tarjetas gráficas dedicadas a esta, por lo que como ya supondréis al menos inicialmente esta memoria HBM estará destinada a gráficas para IA, en la que NVIDIA está poniendo mucho ahínco y que de hecho ya utilizan este tipo de memoria, pero en versiones anteriores, claro.

Con todo, y aunque sin duda NVIDIA es el principal fabricante de chips para IA en la actualidad, no hay que desmerecer los esfuerzos de AMD e Intel al respecto:

- De cara a 2024, AMD se centrará en la serie MI300 que usa HBM3 y no pasaría a la siguiente generación (HBM3e) hasta las próximas gráficas MI350. Se espera que AMD comience a verificar HBM3e durante la segunda mitad de 2024, y no sería hasta el primer trimestre de 2025 que veríamos los primeros productos con este tipo de memoria implementada.

- En cuanto a Intel, en 2022 ya lanzaron la Gaudi 2 pero que utilizaba la ya arcaica memoria HBM2E. Se espera que a mediados de 2024 lancen la Gaudi 3, pero que seguiría utilizando este mismo tipo de memoria.

HBM4 llegaría en 2026

El lanzamiento de la memoria HBM4 está previsto para 2026, con unas especificaciones y rendimiento mejorados con respecto a la HBM3e, pero desafortunadamente todavía no se conocen los planes que tiene, NVIDIA, Intel o AMD al respecto (aunque se especula que Intel, que como hemos visto hace un momento se está quedando obviamente atrás, podría pegar el salto de HBM2E a HBM4 sin pasar por HBM3).

¿Veremos gráficas gaming con memoria HBM?

Esta es la pregunta del millón. Inicialmente no hay ninguna señal que nos indique que NVIDIA tenga intención de implementar la memoria HBM en gráficas convencionales tal como hizo AMD con sus gráficas R9 Fury allá por julio de 2015.

Sin embargo, tampoco hay ninguna señal que cierre las puertas a esto. De hecho, si nos atenemos a los precedentes, es bastante frecuente que los fabricantes implementen nuevas tecnologías primero en productos profesionales (como son las gráficas para IA de NVIDIA) y que más tarde lleguen al mercado de consumo (es decir, el nuestro). Lamentablemente, no nos queda otra alternativa que esperar a ver hacia dónde gira la veleta.