Uno de los problemas que enfrenta Intel en la actualidad es mantener la supremacía de sus CPUs en un apartado como es el gaming. Habiendo perdido la batalla de los núcleos hay que entender que los dos mercados que le quedan son la gama mainstream y los portátiles, donde gran parte del sector es el gaming. Por ello, uno de los aspectos más importantes para mantenerse serán las mejoras de las cachés, algo que comenzó hace años con su tecnología Smart Cache, pero ¿qué es exactamente?

No se puede entender el presente y sobre todo el futuro de Intel en gaming sin una característica como Smart Cache, por lo que, aunque esta tecnología es ya una veterana, al mismo tiempo es una desconocida y muchos olvidan su importancia dentro de una CPU.

Debido a esto, es un buen momento para conocerla más a fondo e intentar comprender los porqués de Intel para mejorarla en Tiger Lake y futuras arquitecturas de núcleo.

Intel Smart Cache, eficiencia y flexibilidad para maximizar el rendimiento

La tendencia de aumentar el número de núcleos viene desde bastante lejos si miramos atrás, pero al mismo tiempo es algo que nos va a acompañar en el futuro. Por lo tanto, tanto Intel como AMD tienen que gestionar cada vez más un número de recursos creciente, más complejo y donde la flexibilidad emerge como concepto clave.

Uno de estos recursos, que podría ser el más importante actualmente, es la memoria caché, la cual es la gran tapada y al mismo tiempo fuente de mayor rendimiento en una CPU. Intel lo vio hace muchos años, tanto que del paso de los Pentium a los Core Duo como arquitectura principal los mayores cambios fueron introducidos en estas características, impulsando el rendimiento y dejando a AMD atrás hasta la llegada de Zen.

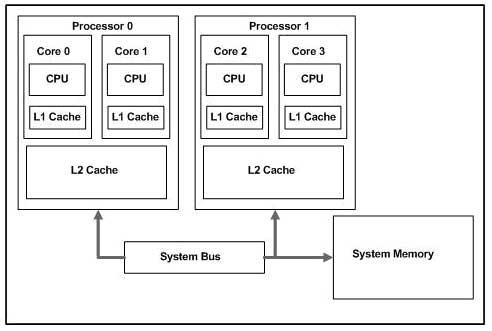

Este cambio de arquitectura de núcleo en base a las cachés tomó por nombre Intel Smart Cache y tuvo como principal novedad el hecho de que ambos núcleos (Dual Core por aquel entonces) tuviesen acceso a toda la L2 (no había L3 en esa arquitectura).

Beneficios de la arquitectura

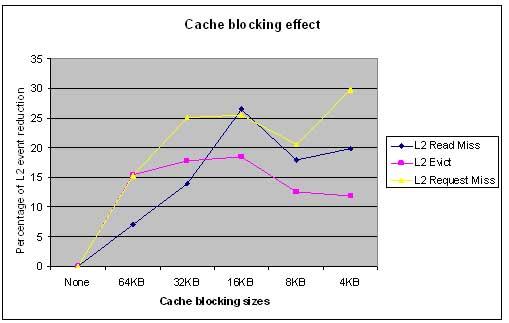

Esto provocó que la eficiencia a la hora de recuperar y trabajar datos con los núcleos se disparase, aumentó la eficiencia y permitió un ahorro de energía mayor cuando un núcleo no tenía que acceder a dicha Smart Cache. Además, redujo la latencia con la memoria RAM del sistema, ya que se podía descargar dinámicamente los datos según la demanda. Por lo tanto, podemos englobar los beneficios de Smart Cache en los siguientes apartados:

- Eficiencia: Si uno o más núcleos están inactivos, el resto puede tomar el control de la caché compartida, lo cual reduce la subutilización de recursos, el acceso a la RAM y la escalabilidad hacia arriba.

- Flexibilidad: Al ser memoria compartida, los datos pueden intercambiarse entre núcleos y subprocesos, aunque se ejecuten fuera de ellos, lo cual incrementa las posibilidades para resolver las tareas en menos tiempo.

- Reducciones: Se reducen el uso compartido falso, se necesita menos carga de trabajo para mantener la coherencia, baja la redundancia de los datos al tener que almacenarlos solo una vez y reduce el tráfico de los buses al no tener que acceder tanto a la RAM del sistema.

Este enfoque de Intel de hace ya casi 10 años es lo que AMD va a poner en práctica en su totalidad en Zen 3, por ejemplo, lo que les permitirá aprovechar estas y otras características y beneficios para reducir el impacto en gaming.

Cabe recordar que todos los motores actuales trabajan con RAMCache predefinida y que no paran de exportar texturas y puntos de objetos o vectores tanto a la GPU como a la CPU. Tener una caché compartida de último nivel y reducir la latencia entre ellas con la RAM es vital si se quiere maximizar el rendimiento, aparte del IPC y esto Intel lo entendió en los tiempos del Core Duo.

Las mejoras en Tiger Lake serán de mayor calado y las veremos en el artículo correspondiente de la arquitectura.