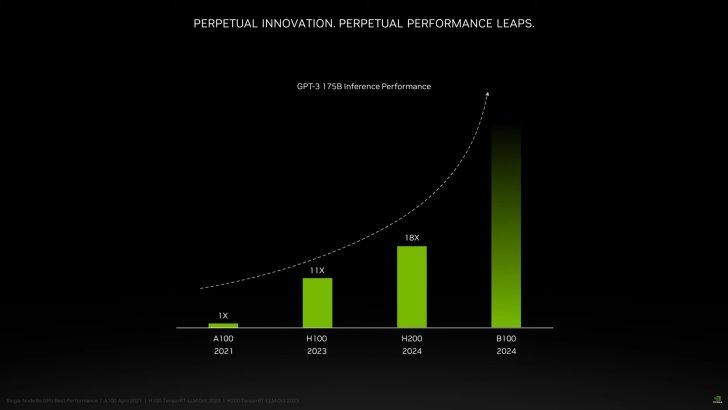

La inteligencia artificial ha generado nuevas vías de negocio, sobre todo, para las grandes empresas. Quien más se está beneficiando de este mercado es NVIDIA, ya que llevan años preparándose y desarrollando tecnologías para este segmento. Ahora, han mostrado un adelanto del rendimiento de las GPU Blackwell B100 de próxima generación que, atención, duplicarán el rendimiento de las Hopper H200.

ChatGPT ha supuesto una explosión de la IA a muchos niveles. Esta tecnología requiere de una enorme potencia de cómputo, siendo esta cada vez mayor. Así que se requiere de hardware especializado que tenga la capacidad de manejar el gran volumen de datos.

Quien mejor posicionada esta en este campo es NVIDIA, que lleva años desarrollando tecnologías esperando este momento. El mejor ejemplo son los Tensor Cores, núcleos específicos para la inteligencia artificial. Unos núcleos que seguramente te suenen, ya que son fundamentales para DLSS.

NVIDIA duplicara la potencia de sus GPU para IA

Durante la conferencia especial SC23, la compañía ha hablado sobre sus próximas GPU de nombre en clave Blackwell. Según han dicho en la presentación, estas ofrecerán más del doble de rendimiento en Inteligencia Artificial que las GPU Hopper, y se lanzarán en 2024.

Según los datos que han dado, la GPU B100 de siguiente generación tendrá un salto de rendimiento realmente brutal. Podría superar los 175 billones de operaciones de inferencia en GPT-3, generando así un enorme salto de rendimiento.

Los dos últimos años NVIDIA ha estado ofreciendo sus soluciones basadas en las arquitecturas Hopper y Ampere. Ambas arquitecturas, al ser perfectas para IA y HPC, le han supuesto a la compañía enormes ingresos. Sobre todo, se han visto beneficiados por la fiebre de la IA, ya que la compañía es la mejor preparada para este mercado.

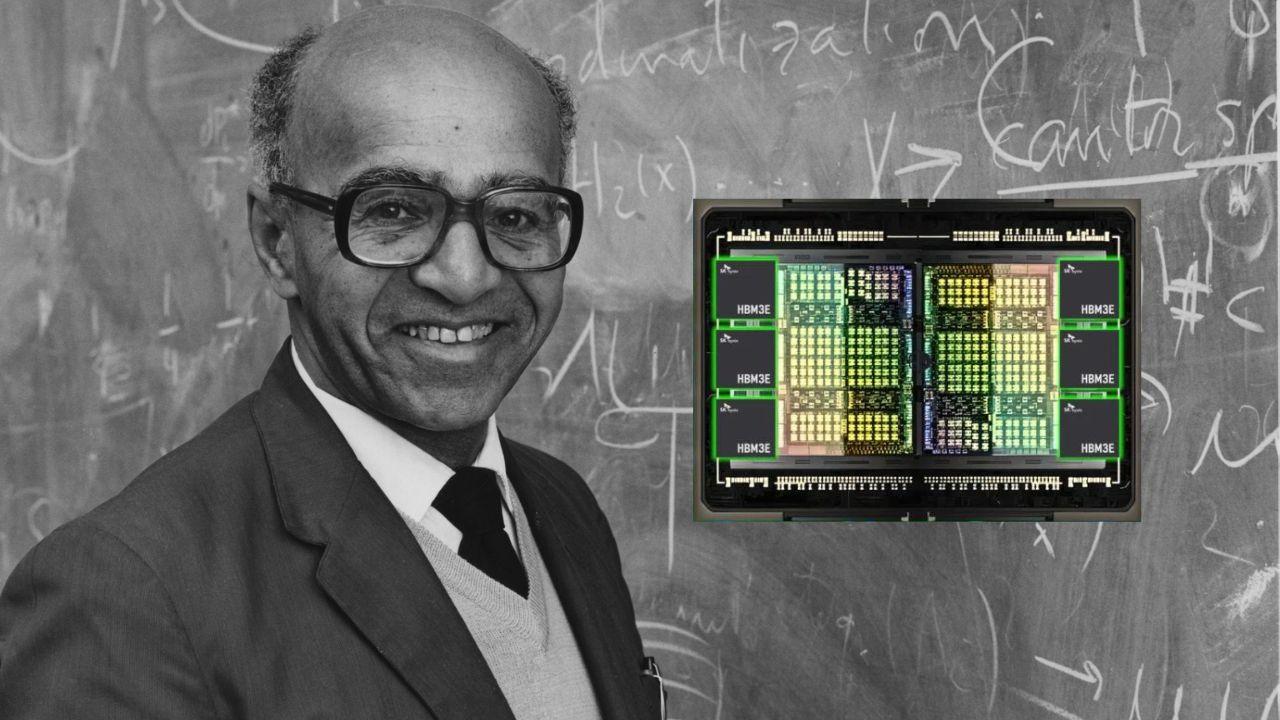

Esta nueva arquitectura debe su nombre a David Harold Blackwell (1919-2010). Para quien no conozca a Blackwell, fue un importante estadista y matemático estadounidense que hizo grandes aportaciones a la teoría de juegos, así como a las teorías de probabilidad e información, así como la estadística.

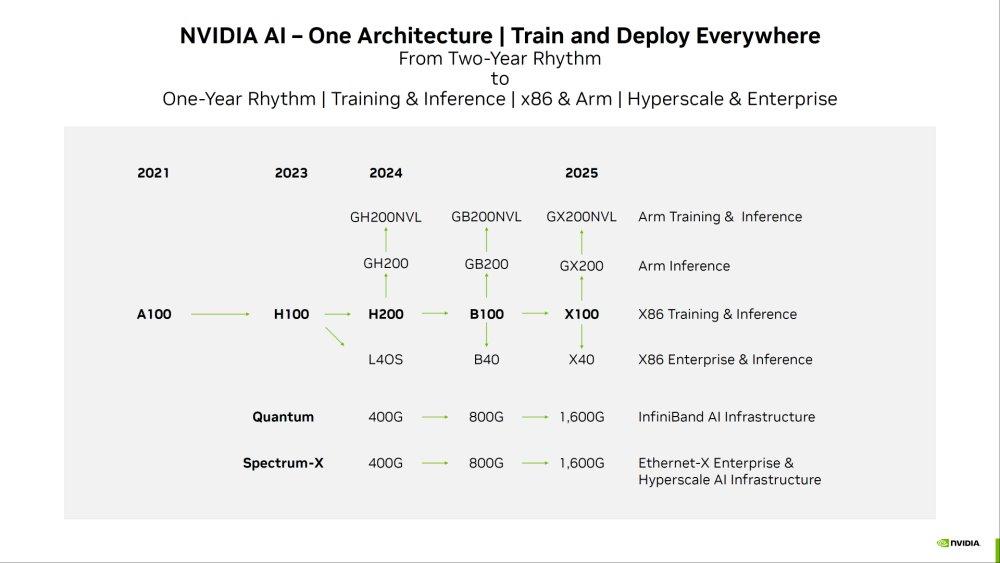

Volviendo a la arquitectura de NVIDIA, la primera solución será el chip B100. Este tendrá varias gamas, como son las GB200 para uso general, las B40 para la aceleración informática visual y GB200NVL con soporte para NVLINK. Serán presentadas durante el próximo GTC que se celebrará en 2024 y se lanzarían después de la presentación.

Quieren mantener su posición en un mercado multimillonario

Según los rumores, las Blackwell de NVIDIA estarían basadas en el nodo de 3 nm de TSCM. Los primeros productos finales serían suministrados a los clientes a finales de 2024. Varias informaciones apuntan a que la compañía está acelerando la producción para tener los primeros productos en el segundo trimestre de 2024.

Aunque no hay confirmación, quien pondría las memorias a estas nuevas GPU sería Samsung. Las informaciones apuntan a que serían los proveedores principales de los chips de memoria.

Blackwell, además, podría ser la primera GPU con diseño Chiplet de la compañía. AMD por su parte, basadas en este diseño, ofrece las Instinct MI300.

La compañía también ha hablado del futuro, concretamente del chip GX200 que relevaría la arquitectura Blackwell. GX200 se podría presentar en 2025 y no llegar al mercado hasta 2026, ya que para el segmento IA y HPC suelen dejar dos años de margen. Aunque, con la subida de la IA en el último año, igual se replantean la estrategia.

Finalmente, NVIDIA también planea grandes saltos en las tecnologías Quantum y Spectrum-X con nuevos productos. Esto podrían ofrecer velocidades de transferencia de hasta 800 GB/s para 2024 y el doble de velocidad para 2025. Estas interfaces de conexión avanzadas están directasmente pensadas para la IA.