El monitor o pantalla de un ordenador es el periférico de salida por antonomasia, a través del mismo nuestro PC se comunica con nosotros y nos muestra en un lenguaje visual que podemos información sobre lo que está ocurriendo en ese momento. Para conectar ambos elementos se han utilizado siempre diferentes salidas de vídeo de las que os hacemos un repaso.

No solo veremos los conectores de vídeo actuales y aquellos que se han quedado por el camino. También veremos como estos conectores de vídeo han supuesto que existen los terminos monitor y televisión. Es importante para entender la existencia de estos conectores y su evolución con el paso del tiempo. Al final, las tecnologías van evolucionando y se van dando cambios que requiren de nuevas soluciones más especializadas. Un cambio que tiene que ver bastante con las GPU y la cantidad de frames que estas pueden ofrecer, así como las resoluciones soportadas.

Salidas de vídeo para monitor y TV

Los primeros ordenadores empleaban pantallas de televisión modificadas, esto es así por el hecho que en plena Guerra Fría existía el temor de que se pudiera modificar el sistema de radiofrecuencia de estos con los ordenadores para temas de espionaje o acceso a las comunicaciones de radio usadas por aquel entonces. Esto hizo que las pantallas de terminal de los ordenadores se vendiesen sin la capacidad de sintonizar, pero al mismo tiempo permitió la implementación de conectores de entrada y salida de vídeo propietarios.

Televisores vs monitores

Hasta la llegada del PC AT en 1984, que trajo el estándar EGA, los monitores para PC eran pantallas de televisión NTSC modificadas, sin embargo, las limitaciones de este formato a la hora de mostrar imágenes con una mayor definición hicieron la necesidad de adoptar nuevos formatos de monitor para PC con una frecuencia horizontal más alta que los 15,7 KHz del NTSC. En ese punto el camino de los televisores y los monitores se separó por 20 años hasta la llegada de los monitores y televisores LCD, sin embargo, la diferencia sigue siendo la misma, la no inclusión de un sintonizador de televisión en el monitor.

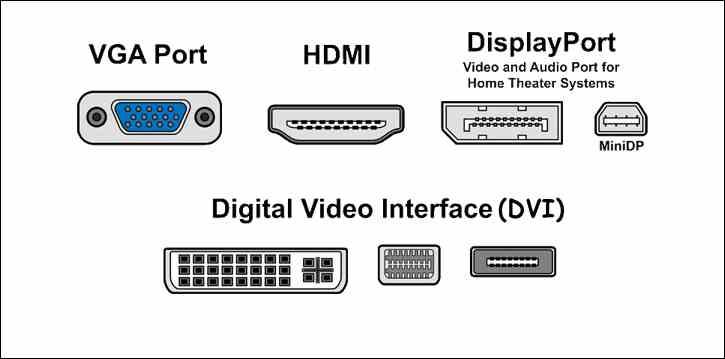

Vamos a centranos principalmente en los conectores de entrada y salida de los monitores. Todos ellos tienen una estrecha relación con los ordenadores, así que vamos a obviar otros conectores. No hablaremos de los conectores S-Video, Componentes, Compuesto, SCART y otros que se encuentran en la parte trasera de las televisones. Hacer eso no tendría mucho sentido y, en todos los casos, son conectores obsoletos que ya apenas se utilizan.

Actualmente en las televisiones, si bien algunos aún están disponibles, en la mayoría de casos están de adornos. Principalmente se utilizan los HDMI y los DisplayPort, conectores de vídeo más modernos y «universales».

Salidas de vídeo en desuso

Los conectores de esta sección son aquellos que podéis observar todavía en muchos ordenadores, pero que por la aparición de tecnologías más avanzadas han caído en desuso. Dicho de otra manera, han sido reemplazados y no van a evolucionar, por lo que si os encontráis un monitor o una tarjeta gráfica con este tipo de conectores, creednos que es muy antigua y no va a otorgar un rendimiento aceptable a día de hoy.

Hemos descartado en el proceso salido de vídeo ya bastante antiguas como los puertos MDA, CGA y EGA para PC, así como puertos clásicos para televisión y monitores como los RGB, componentes y compuesto que por no usarse en los monitores desde hace ya décadas no dejarían de ser una simple anécdota histórica.

VGA

Cualquier PC de los años 90 y la primera mitad de los 2000 utilizaba el VGA, un conector de vídeo del tipo RGB, ya que enviaba la información de los componentes de color en tres canales distintos, el conector también tiene los pines para controlar la sincronización horizontal y vertical del monitor, la cual por aquel entonces era controlada por la propia tarjeta gráfica. Los pines de sincronización nos indican que se trata de un puerto pensado para monitores que emplean un tubo de rayos catódicos para generar la imagen.

Al ser un puerto para un monitor de PC no transporta audio y es que cuando el VGA apareció por primera vez en el PC se empleaba el altavoz interno o en su defecto las por aquel entonces nuevas tarjetas de sonido para reproducir el audio y no los monitores, los cuales como habréis deducido no tenían ninguna capacidad para reproducir sonido.

Debido a su naturaleza analógica no se lleva nadie bien con los paneles LCD, lo que llevó a la necesidad de crear una interfaz digital con tal de conseguir una buena calidad de imagen. El motivo por el cual ocurre esto tiene que ver con el conversor de señal analógica a digital que hace que en la conversión se pierda información al usar un puerto VGA.

DVI (Digital Video Interface)

Con el paso del tiempo, los paneles LCD se fueron abaratando y los usuarios empezaron a comprarlos por el hecho que permitían ahorrar espacio en sus escritorios respecto a los clásicos monitores de tubo. Aunque la diferente naturaleza a la hora de mostrar la imagen en pantalla obligaba a hacer cambios en las salidas de vídeo en los PC, de ahí el nacimiento del DVI.

¿Las diferencias con el VGA?

- Para empezar, asigna a dos pines a cada uno de los tres canales RGB,

- Aunque pese a ser un puerto digital, mantiene los pines HSync y VSync, pero apenas son utilizados. En realidad lo hace con una serie de pines desde donde el monitor envía la información sobre la resolución y la frecuencia de refresco, de esta manera el envío de la señal se autoconfigura y no es necesario el uso de pines de sincronización.

- Los primeros puertos que aparecieron fueron los DVI-I, ya que disponen de los pines para el empleo en monitores analógicos, no obstante con el tiempo se estandarizó el DVI-D que está pensado puramente para las pantallas LCD al carecer de los pines para las pantallas CRT.

Del conector para vídeo DVI hubo dos generaciones distintas, por un lado, la SL con una resolución máxima de 1920 x 1200 píxeles y por el otro la DL con una resolución de 2560 x 1600 píxeles también a 60 Hz. Por cierto, el DVI nunca soportó tasa de frecuencia variable y con el tiempo fue reemplazado rápidamente por el HDMI y el DisplayPort.

Salidas de vídeo en uso en la actualidad

Vamos ahora a ver los conectores de vídeo utilizados en la actualidad en tarjetas gráficas, consolas, monitores y televisiones, principalmente. Principalmente tenemos dos conectores de vídeo, como son HDMI y DisplayPort, que se disputan el mercado. Debido a que ofrecen una gran escalabilidad (soportan cada vez más resolución) seguramente duren muchos años. Igual en el futuro se desarrolla otro tipo de conector de vídeo, aunque parece poco probable en la próxima decada.

HDMI

El más utilizado en la actualidad y con casi veinte años de evolución ha pasado de mostrar imágenes a 720p en su versión 1.0 a resoluciones 8K con el 2.1, lo que supone un aumento de 50 veces más píxeles respecto a su origen. En su evolución hemos visto añadidos como el soporte a varios ratios de aspecto, tasa de frecuencia variable, HDR, etcétera.

El puerto HDMI nació como una variante del DVI, pero no coincide en su diseño y forma, así como la distribución de los pines. ¿Las diferencias con el DVI? Dado que se creó como salida de vídeo para contenido audiovisual, este puede transportar audio y además contiene vídeo para el HDCP, el sistema de protección de contenido empleada aún a día de hoy por la industria audiovisual.

HDMI está pensado para dar la señal sin pérdidas con una distancia de hasta 5 metros de distancia, una distancia mucho más grande entre la señal de salida y la de entrada acaba generando pérdidas en la calidad de la señal, por lo que es importante tener lo más cerca posible el PC del monitor si se utiliza un conector de vídeo de este tipo.

Presenta un problema este conector de vídeo y es que solo permite la transferencia de audio y vídeo. No ofrece la capacidad de transferir datos, como si pasa en el conector DisplayPort que veremos a continuación. De momento, no parece que esta opción sea posible, ya que seguramente requiera un rediseño complecto del conector de vídeo. Actualmente este muy extendido y realizar un cambio tan drastico podría generar problemas de compatibilidad.

DisplayPort o DP

El otro conector de vídeo más usado en los monitores y tarjetas gráficas para PC es el llamado DisplayPort, el cual al igual que el HDMI ha tenido varias generaciones diferentes en su evolución hasta el día de hoy. La gran diferencia es que nacieron de dos comités de estandarización distintos y es por ello que DisplayPort se ve más en monitores que en televisores. Es más, muchas veces una buena manera de saber si una pantalla es un televisor o un monitor es la inclusión de este puerto.

La gran diferencia entre el HDMI y el DisplayPort, aparte de su forma y distribuciones de los pines, está en que el soporte HDCP para cierto contenido no es obligatorio en una interfaz DP, esto hace que para consolas de videojuegos y reproductores de vídeo este tipo de conector no se utilice, ya que dicho soporte es esencial para la reproducción de contenido audiovisual comercial. Es por ello que el DisplayPort se ha convertido en un puerto asociado a día de hoy al PC. No obstante, al contrario del DVI y el VGA y también al igual que el HDMI, el DisplayPort tiene la capacidad de transmitir también audio.

DisplayPort a través de USB

Es una integración de DisplayPort dentro del estandar USB. Para que esto posible se deben cumplir ciertos requisitos, siendo el más importante que debe ser el conector compatible con Thunderbolt. Además, solamente es posible si se hace uso del conector USB-C.

Una de las caracteristicas más interesantes es que este conetor USB-C puede llegar a suministrar hasta 240 vatios (deberemos revisar bien las especificaciones). Esto lo que permite es la alimentación de la pantalla directamente mediante el cable USB. No siempre es posible, ya que se requiere compatibilidad entre el puerto y el monitor.

Averiguar si un puerto USB-C es compatible con DisplayPort es bastante sencillo. Los fabricantes lo indican en las especificaciones, concretamente, se describe como USB-C Alt-DP. Esta abreviación sencillamente nos dice que este USB-C, además de para transferir datos, también puede ser usado como salida de vídeo, ofrecienco la «alternativa DisplayPort».

Como puedes observar hay muchas variantes, sobre todo con el paso del tiempo, sin embargo, aunque todas funcionan, tienen velocidades y calidades de imagen diferente, por eso, a la hora de adquirir un monitor u ordenador, asegúrate de que posee las mejores conexiones. Es la mejor forma de saber, también, la edad de un equipo. Si solo tiene HDMI, es probable que sea bastante antiguo, y si nisiquiera trae este puerto, entonces ya es mejor que ni lo plantees adquirir.

Como ejemplo te podemos decir que un HDMI de última generación otorga una velocidad de transmisión de 48 GB/s mientras que DisplayPort lo hace a más de 77 GB/s, la diferencia es notable, sobre todo si piensas conectar o reproducir contenido en 4K o superior. Otra cosa a tener en cuenta si pensamos adquirir un ordenador por muchos años, es probable que acabemos con resoluciones mucho mayores, por lo que es importante pensarlo cuanto antes.