NVIDIA dice que la Ley de Moore está muerta, empieza la Ley de Huang

Como todos sabemos, la conocida Ley de Moore ha promovido el rápido desarrollo de los procesadores en el último medio siglo, pero hay que reconocer que en los últimos años se ha ralentizado sensiblemente y los fabricantes de chips están teniendo problemas para poder seguir cumpliéndola. Durante la conferencia GTC 2020, NVIDIA ha dicho sin pelos en la lengua que para GPUs la ley de Moore lleva tiempo muerta, y que lo que impera ahora es la Ley de Huang.

Durante el GTC 2020 celebrado el 15 de diciembre (por supuesto, en un evento online) el científico jefe de NVIDIA, Bill Dally, pronunció un discurso de apertura centrándose en el progreso de su equipo de investigación de IA, donde puso especial énfasis en el nombre del fundador y director ejecutivo de NVIDIA, Jen-Hsun Huang, y afirma que ahora lo que impera es la Ley de Huang pero, ¿qué es esta ley?

La ley de Huang describe el desarrollo de la IA en GPUs

Bill Dally, científico jefe de NVIDIA, posee en la actualidad más de 120 patentes, y es que no en vano fue el director del departamento de Ciencias de Computación en la universidad de Standford antes de entrar a formar parte del equipo de NVIDIA en el año 2009. Actualmente es el jefe de investigación en los campos de IA, trazado de rayos e interconexión de alta velocidad.

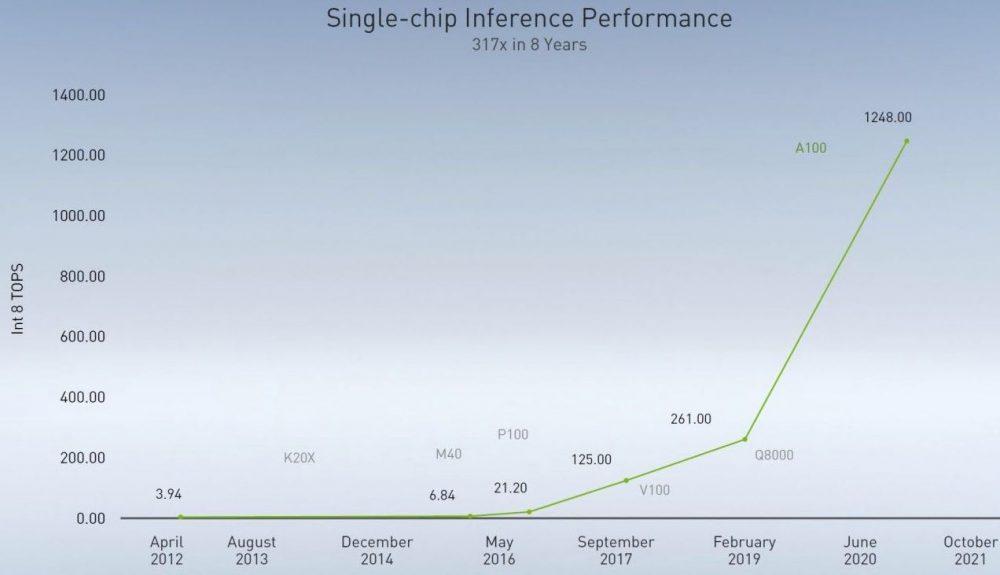

En la mencionada conferencia, Dally utilizó tres proyectos para describir cómo su equipo de investigación de más de 200 personas implementó con éxito la «Ley de Huang», y predijo audazmente que la GPU duplicará su rendimiento en IA cada año.

Para lograr este avance, NVIDIA ha desarrollado una herramienta especial llamada MAGNet. Se trata de un acelerador de razonamiento de Inteligencia Artificial que puede alcanzar una velocidad de razonamiento de 100 TOPS/W (100.000 millones de operaciones por vatio de energía consumido) según las primeras pruebas de simulación que han realizado con ello, una velocidad mucho más alta que cualquier procesador de IA de la actualidad.

MAGNet adopta una serie de nuevas tecnologías para coordinar y controlar el flujo de información a través del dispositivo para minimizar la transmisión de datos, que es el enlace de energía que más consume en los chips actuales. Además, NVIDIA también ha estudiado un tipo de enlace óptico mucho más rápido que puede reemplazar a los enlaces eléctricos actuales; al utilizar tecnología de multiplexación por división de longitud de onda densa, se espera lograr transmisiones de datos de más de 1 TB/s con chips de 1 nanómetro, lo que supondría 10 veces más velocidad de lo que se tiene con la tecnología actual.

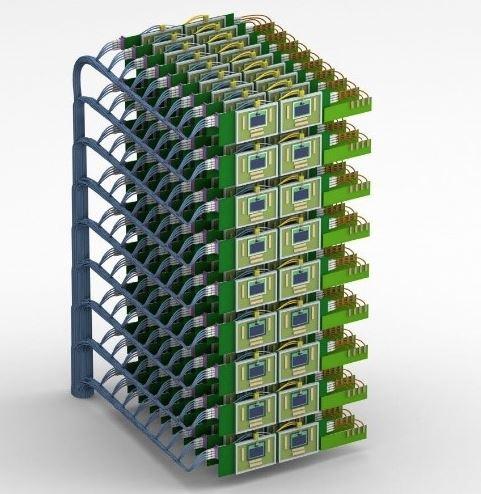

Bill Dally también mostró un ejemplo (que podéis ver en la imagen de abajo) de un nuevo modelo de sistema NVIDIA DGX que puede integrar más de 160 GPUs con la ayuda de este mismo tipo de enlaces ópticos.

Desde luego que NVIDIA parece muy pero que muy optimista para formular esta «Ley de Huang» de la que hablan, pero lo cierto es que nadie puede negar que en los últimos años están enfocando muchísimo esfuerzo y dinero en implementar nuevas tecnologías de Inteligencia Artificial, pues parecen decididos a que este sea el futuro de la compañía. Veremos en qué queda todo.