Hoy en día, máxime con el auge de los equipos Gaming, la tarjeta gráfica es uno de los principales componentes de cualquier PC, y de hecho en estos casos suele ser el componente más caro. En este artículo os vamos a explicar qué es una tarjeta gráfica, cuáles son sus funciones, qué tipos hay, un poco de historia sobre ellas.

Generalmente, todo usuario de PC sabe qué es la tarjeta gráfica y para qué sirve, o al menos sabe que cuanto más potente sea ésta mejor funcionarán los juegos. Sin embargo, en este artículo pretendemos ahondar un poco más en lo que es y lo que hace para que podáis ser conscientes de su importancia a la hora de armar un PC. No obstante, vamos a empezar por el principio.

¿Qué es la tarjeta gráfica?

Es una parte importante en los ordenadores ya que permite generar una fuente de salida de video hacia un dispositivo de visualización, como son los monitores. Aunque se las suele asociar a los videojuegos, su finalidad es que podamos interactuar con el ordenador de una manera sencilla e intuitiva.

Su corazón es la unidad de procesamiento gráfico (GPU) que se encarga de realizar los cálculos necesarios para que podamos ver una interfaz gráfica sencilla en una pantalla. Actualmente, la mayoría de tarjetas gráficas ofrecen múltiples salidas de video.

Una de las principales funciones de una gráfica es la de realizar calculos complejos en apoyo del procesador. Permite reducir la carga de este componente en diferentes procesos.

Actualmente, los usos de una tarjeta gráfica son mucho más variados que para mostrar imagen y jugar. Se puede usar para realizar topografía de terrenos, mapas climáticos en tiempo real, simulación molecular, entrenamiento y uso de inteligencia artificial, minería de criptomonedas y mucho más.

¿Por qué se inventaron las tarjetas gráficas?

La historia de las tarjetas gráficas comienza a finales de los años 60, cuando se deja de utilizar impresoras como principal elemento de visualización y entran en juego los monitores. Las primeras tarjetas gráficas solo eran capaces de mostrar una resolución de 40 x 25 píxeles monocromo (blanco y negro o escala de grises, aunque dependiendo del monitor utilizado a veces eran verdes), hasta que aparecieron los primeros chips gráficos dedicados como el Motorola 6845.

Más tarde comenzaron a aparecer las primeras videoconsolas y el éxito del PC (Personal Computer, ordenador doméstico) tuvo un gran auge, abaratando mucho los costes de producción dado que se fabricaban ya en masa. Al principio, las tarjetas gráficas que se comercializaban eran de 80 columnas, que añadían un modo texto de hasta 80 x 25 caracteres (no píxeles), principalmente para software CP/M. Después, llegaron los famosos IBM PC que popularizaron el diseño “intercambiable” de las tarjetas gráficas. La más extendida fue la MDA (Monochrome Display Adapter) que IBM creó en 1981. Esta gráfica contaba con una memoria gráfica de 4 KB y era capaz de representar en el monitor hasta 25 líneas de texto de 80 caracteres cada una.

A partir de ahí se entró en un ciclo de competencia en el mercado de PC, con nombres que os sonarán mucho tales como Commodore, Amiga 2000 y Apple Macintosh. Estos equipos comenzaron a utilizar tecnología propietaria para la tarjeta gráfica, integrando la GPU en la placa base. Esta situación se mantiene hasta la aparición de otro integrante que también os sonará: el puerto PCI.

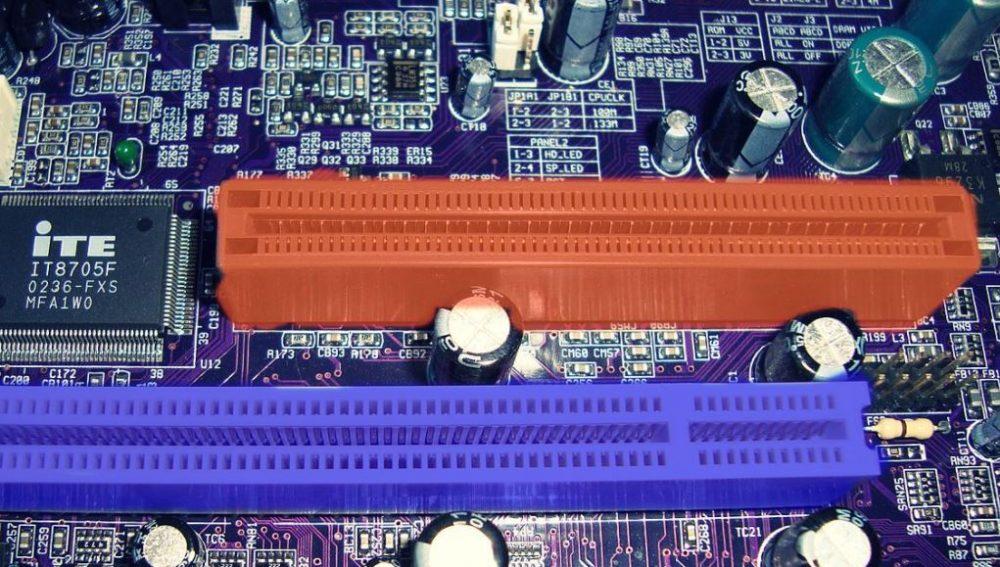

El PCI eliminaba el cuello de botella de la interfaz anterior (ISA), y comenzaron a desarrollarse los primeros adaptadores 3D profesionales (S3 ViRGE). Se comenzó a la fabricación masiva de gráficas para zócalos PCI. A partir de ahí, la industria evolucionó hasta como la conocemos hoy en día, con los siguientes hitos destacados:

- En 1995 aparecieron las primeras tarjetas gráficas 2D/3D fabricadas por Matrox, ATI, S3 y Creative entre otros. Cumplían con el estándar SVGA pero con funciones 3D.

- En el año 1997, 3DFX lanzó el que posiblemente sea el chip gráfico más famoso de todos los tiempos: Voodoo. Éste tenía una potencia de cálculo ingente para la época y añadía diversos efectos 3D como Mip Mapping, Z-Buffering y Antialiasing. A partir de ésta, se lanzaron diversos modelos conocidos como el Voodoo2 de 3DFX, TNT de Riva y después, el TNT2 de NVIDIA (después de adquirir Riva).

- Tal era la potencia de esas gráficas que el puerto PCI se quedó corto, pero llegó Intel para desarrollar el puerto AGP (Accelerated Graphics Port) que solucionó los cuellos de botella que ya había en ese entonces.

Entre 1999 y 2002, NVIDIA se hizo con la hegemonía del mercado de tarjetas gráficas (entre otras cosas compró 3DFX) con su familia GeForce. En ese periodo hubo gran cantidad de mejoras gráficas en el entorno 3D. Las gráficas destacadas de aquellos tiempos tenían hasta 128 MB de memoria DDR.

- La mayor parte de las consolas de aquellos tiempos utilizaban chips gráficos basados en las tarjetas aceleradoras 3D. Los Apple Macintosh usaban chips de NVIDIA y ATI.

- En 2006 AMD compra ATI, y se hace rival directo de NVIDIA en el mercado de tarjetas gráficas. Desde entonces se repartieron el liderazgo con sus respectivas familias GeForce y Radeon, y así siguen hasta el día de hoy.

Tipos de tarjetas gráficas

Podemos distinguir, actualmente, entre varios tipos o formatos de tarjetas gráficas. Estas se catalogan dependiendo de si están «unidas» al procesador o bien se «pinchan» en la placa base. Te explicaremos los dos formatos actuales en los que llegan las tarjetas gráficas

Tarjeta gráfica integrada (iGPU)

Antiguamente, muchas placas base integraban su propia GPU entre sus circuitos, pero actualmente esto se dejó de hacer para dar paso a las llamadas iGPU o gráficas integradas, que vienen ya en el propio procesador (las placas base, no obstante, siguen integrando las salidas de vídeo). Estas gráficas integradas tienen lógicamente una potencia bastante reducida, y además necesitan tomar parte de la memoria RAM del sistema para ellas mismas.

En la actualidad, tanto AMD como Intel cuentan con gráficas integradas en sus procesadores. El principal motivo es que los procesadores gráficos son muy potentes a la hora de realizar procesos paralelos, y ubicar la GPU junto con la CPU permite utilizar los gráficos integrados para realizar muchos procesos además del procesamiento de gráficos propiamente dicho (Ver arquitectura de sistemas heterogéneos).

Tarjeta gráfica dedicada (dGPU)

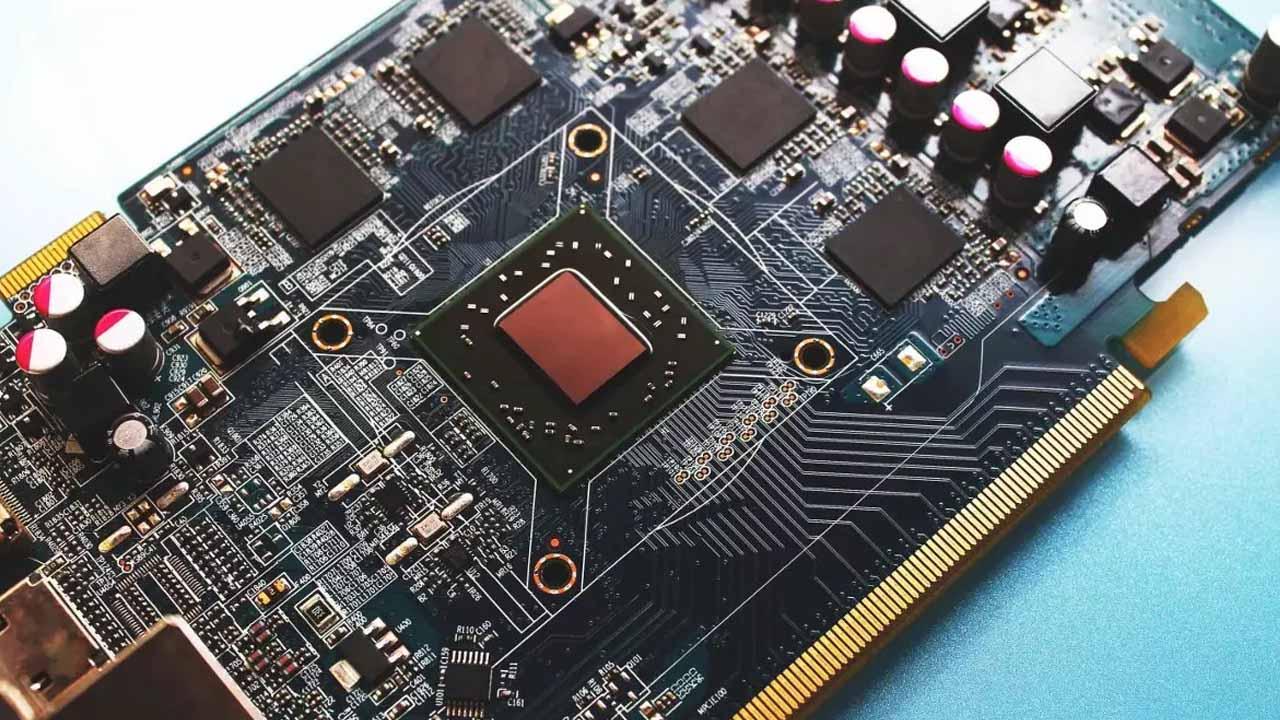

Las tarjetas gráficas dedicadas son las que todos conocemos: placas de vídeo que tienen su propia GPU, memoria gráfica, salidas de vídeo y sistema de refrigeración y que se conectan a la placa base a través de un puerto PCI-Express. Proporcionan un nivel de rendimiento muy superior a los gráficos integrados, pero también son bastante más caras, si bien nos permiten el poder actualizar o sustituir el componente de una manera mucho más sencilla.

Hoy en día, muchos fabricantes dicen que se puede llegar a jugar de forma decente con una gráfica integrada, pero la realidad es que sin una tarjeta gráfica dedicada puedes olvidarte de tener una buena experiencia gaming.

Las salidas de vídeo

Cuando hablas de una tarjeta gráfica, es importante mencionar también sus salidas de vídeo, ya que como hemos explicado antes, al fin y al cabo son una especie de procesador de vídeo que sirve para que podamos ver la imagen en un monitor… y para ello es necesario poder conectarlo de alguna manera. Se conoce como salidas de vídeo a los puertos de conexión que se utilizan para conectar la tarjeta gráfica al monitor.

Hay muchos tipos de salida de vídeo diferentes, pero en la actualidad se utilizan únicamente las siguientes:

- VGA (totalmente en desuso): significa Video Graphics Array, y fue el estándar de vídeo analógico en la década de los 90. Estaba diseñada para monitores CRT, y sufre bastante de ruido eléctrico y distorsión en la conversión de analógico a digital, por lo que los cables VGA suelen llevar filtro de línea en el propio cable. Su conector se llama D-sub y tiene 15 pines.

- DVI (totalmente en desuso): Significa Digital Visual Interface, y sustituye a la anterior. Es totalmente digital, por lo que no hay que hacer conversión, eliminando gran parte del ruido eléctrico y la distorsión. Ofrece una mayor calidad y mayores resoluciones posibles.

- HDMI: Significa High Definition Multimedia Interface, y actualmente es el que más se utiliza. Cuenta con cifrado sin compresión y es capaz de transmitir audio a la vez que vídeo, ofreciendo resoluciones todavía más altas.

- DisplayPort: Actualmente es el “rival” del HDMI. Se trata de una tecnología propietaria de VESA que también transmite audio y vídeo, pero a mayor resolución y frecuencia que HDMI. Tiene como ventaja que está libre de patentes, por lo que es más fácil que su uso se extienda (actualmente prácticamente todas las gráficas llevan DisplayPort). Cuenta con una versión de tamaño reducido llamada Mini DisplayPort de iguales características que permite la inclusión de muchos más puertos en una misma tarjeta gráfica.

- USB-C (totalmente en desuso): algunas gráficas modernas ya incorporan salida de vídeo mediante conector USB-C, si bien es cierto que en realidad utiliza el mismo protocolo que DisplayPort para funcionar.

Las mejores tarjetas gráficas

Cada año, o a lo sumo cada dos años, llegan al mercado nuevas tarjetas gráficas más potentes y con nuevas tecnologías (como el nuevo trazado de rayos en tiempo real (Ray Tracing) para los videojuegos) que nos ofrecen una experiencia mucho más realista en los juegos.

Por este motivo, no tiene mucho sentido hablar de «las mejores tarjetas gráficas» porque cada poco tiempo cambian, pero sí que podemos tener algunas nociones, como por ejemplo:

- En 2023, la tarjeta gráfica más potente hasta la fecha es la NVIDIA GeForce RTX 4090.

- Por norma general, las tarjetas gráficas más vendidas y que más se utilizan son las series de gama media y media alta, tanto de NVIDIA como de AMD. Esto serían las RTX 4060 y las RX 7600.

Cómo elegir una tarjeta gráfica

Existen una gran cantidad de componentes que podemos elegir en nuestro PC, y las GPU son uno de ellos, ya que podemos encontrar diversas versiones de las tres marcas principales, Intel, AMD y NVIDIA, cada una ofrece una serie de diferencias frente al resto, haciendo que en ocasiones nos preguntemos cual es mejor. De primeras, está claro que si nos referimos a potencia, siempre tendríamos que optar por una gráfica de última generación de NVIDIA, ya que actualmente tienen las GPU más potentes, como bien hemos mencionado anteriormente.

Pero esto no implica que sean las mejores para todos los casos, ya que al final depende de para qué vayamos a utilizarla, dependiendo sobre todo del presupuesto que tengamos, ya que al final si tenemos mucho dinero, podemos hacer la inversión de comprar una 4090, pero si no tenemos demasiado obviamente deberíamos optar por una menos potente. En cualquier caso, una de las cosas que debemos tener en cuenta siempre a la hora de elegir qué tarjeta gráfica utilizar es las características clave que tiene, relacionadas con la VRAM, la frecuencia del reloj y el diseño que tienen.

Para la VRAM, actualmente el estándar para la mayoría de casos lo podríamos encontrar en 8 GB, mientras que la frecuencia del reloj debería ser superior a los 1800 MHz, ya que esto es lo que podríamos considerar una GPU de potencia media, como es el caso de la RTX 4060, que supera estas características. De esta forma podremos diferenciar la potencia que son capaces de ofrecer, aunque está claro que conseguir una tarjeta de vídeo nueva actualmente es bastante caro, por lo que es posible que queramos optar por modelos más antiguos, aunque esto no es lo recomendable ya que cada vez los requisitos de todas las aplicaciones son mayores.